페이스 랜드마크 트래킹과 메타휴먼 재구성을 활용한 AI 기반 운전자 졸음 감지

Abstract

Drowsy driving poses a significant risk, resulting in an average of 2.9 fatalities per 100 accidents—nearly twice the 1.5 fatalities associated with drunk driving. Cognitive function declines when in-vehicle CO2 levels exceed 2,000 ppm, indicating the necessity for real-time drowsiness detection. This study proposes an AI-based face-tracking system that integrates drowsiness detection with CO2 measurement. Infrared cameras within VR HMDs capture subtle facial muscle movements, which are transmitted to a metahuman model within a 3D engine via Live Link. A supervised model, trained on 2,400 metahuman images, underpins drowsiness detection. The metahuman background color dynamically adjusts in response to CO2 concentration, facilitating intuitive monitoring. If prolonged drowsiness is detected, the system issues a warning. The performance of the AI model was validated using k-fold cross-validation and mean average precision. This approach enables real-time driver monitoring by delivering multistage warnings, immediate feedback, and vehicle control interventions when necessary.

Keywords:

VR HMD, 3D simulation engine, Face tracking, Object detection, CO2 concentration1. 서 론

졸음운전은 교통사고의 주요 원인 중 하나이다. 경찰청 교통사고 통계에 따르면, 2019년부터 2023년까지 졸음운전으로 10,765건의 교통사고가 발생하였으며, 316명이 사망하였다. 사고 100건당 사망자는 평균 2.9명으로, 같은 기간 발생한 음주 운전 사고의 100건당 평균 사망자 1.5명보다 약 2배 높다. 고속도로에서 발생한 졸음운전 사고에서는 사고 100건당 평균 8.3명이 사망하였다. 일반국도, 지방도, 군도와 같은 통행 속도가 빠른 도로에서도 사망률이 높게 나타났다[1]. 졸음운전으로 인한 사고 위험성이 크다는 점이 확인된다. 동시에 차량 내부의 밀폐 공간에서 발생하는 CO₂ 농도 상승은 운전자의 집중력을 저하시켜 사고 발생 확률을 높이는 주요 원인이다. CO2 농도가 2,000 ppm을 초과하면, 운전자의 인지 기능이 급격히 저하되고 반응 속도가 지연된다[2]. 이러한 문제들은 운전자에게 치명적이므로, 운전 피로 상태를 실시간으로 감지하고 적절히 피드백을 제공하는 시스템이 요구된다.

운전자의 졸음 및 피로 상태를 연구하기 위해 시뮬레이션 환경을 도입하였다. 시뮬레이션 환경은 도로 조건, 주변 배경, 조명 등 다양한 환경 변수를 조절할 수 있어 실험 조건을 정밀하게 설정하는 데 유리하다. 또한, 운전자의 몰입도를 높이고 실제 운전 상황과 유사한 환경을 제공하기 위해 VR HMD(virtual reality head-mounted display)를 활용하였다.

운전자의 졸음 및 피로도를 감지하기 위한 다양한 기술들이 연구되고 있다. 이러한 기법에는 안면인식, 생체 신호 분석, 뇌파 측정, 그리고 열화상 카메라를 활용한 비접촉 방식 등이 포함된다.

먼저, 안면인식을 활용하는 방법은 얼굴 영상에서 눈 깜박임 빈도, 눈꺼풀 감김 정도, 하품, 고개 기울임 등을 실시간으로 추적하여 운전자의 피로도를 감지한다[3]. 심박수 및 심박변이도를 기반으로 한 접근법은 교감・부교감 신경계 밸런스 변화에 따른 심박 신호 RMSSD(root mean square of the successive differences), 저주파 및 고주파 비율의 변동폭 등을 모니터링하여, 피로가 누적되면 특정 지표가 임계값 이상으로 상승한다는 점에 근거해 피로도 상태를 판단한다[4]. 뇌파를 활용한 방법은 실시간으로 운전자의 뇌파 EEG(electroencephalogram)를 측정하여 주의와 피로도 수준을 감지하게 된다. EEG 신호는 운전 중 장기적 변화와 단기적 변화 양상을 나타내며, 피로도가 누적될 때 전형적인 뇌파 패턴이 관찰된다[5]. 열화상 카메라를 활용한 비접촉 방식은 눈 주변, 이마, 콧등의 미세 온도 변화를 분석하여 졸음 상태를 추정한다. 또한, 열화상 영상을 머신러닝 알고리즘과 결합함으로써 측정 정밀도를 높일 수 있다[6]. 이 중 얼굴 온도 변화로 졸음을 예측하는 방법은 초기 연구 단계에서 비접촉 방식으로 수행될 수 있다는 장점 때문에 이에 대한 연구가 진행되었다. 그러나 VR HMD를 착용한 상태에서는 기존의 얼굴 온도 기반 졸음 측정 기법에 한계를 가지게 된다. VR HMD에서 발생하는 열이 얼굴 온도에 영향을 주어 실제 피로 상태와 무관하게 온도가 상승할 가능성이 있다. 또한, VR HMD 착용으로 인해 얼굴 상단부가 가려져 측정 범위가 제한되는 문제가 나타난다.

이러한 문제를 극복하기 위해 본 연구에서는 VR HMD의 페이스 트래킹과 AI 기술을 활용한 실시간 졸음 감지 시스템을 제안한다. VR HMD 내장 IR 카메라를 통한 안면 근육 움직임 추적 및 CO2 농도 기반 언리얼 엔진(Unreal Engine) 시뮬레이션을 구현하였다.

2. 시스템 구성

2.1 페이스 랜드마크 기반 표정 추적

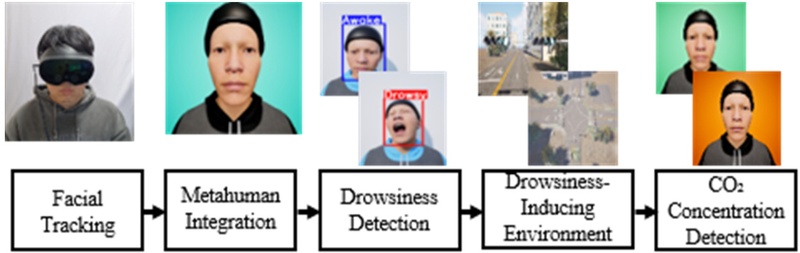

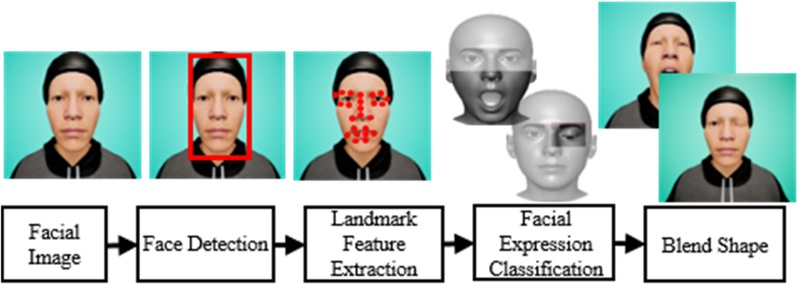

Fig. 1은 전체 시스템의 구성 흐름을 나타낸다. 전체 시스템은 얼굴 감지를 시작으로 메타휴먼(Metahuman) 연동, 졸음 감지, CO2 농도 시각화의 순서로 진행된다. 구현된 전체 시스템은 졸음이 감지되거나 CO₂ 농도가 높아지면 시각적 및 청각적 경고를 제공한다. 일반적으로 페이스 트래킹을 통해 표정을 추출하는 과정은 Fig. 2에 요약되어 있다. 전체 프로세스는 페이스 검출, 페이스 랜드마크 추출, 랜드마크의 움직임 변화 측정을 통한 표정 분류, 최종적으로 Meta가 정의한 BlendShape 형식으로의 변환으로 구성된다. 먼저, 페이스 검출 단계에서는 비디오 혹은 이미지 프레임으로부터 얼굴 영역을 찾는다. Viola와 Jones가 제안한 Haar Cascade Classifier, HOG(histogram of oriented gradients)+SVM(support vector machine), MTCNN(multi-task cascaded convolutional networks), RetinaFace 등이 대표적으로 사용된다[7-10]. 검출된 페이스 영역에 바운딩 박스가 생성되며, 이후 단계에서는 이 영역을 기반으로 랜드마크가 정의된다. 다음 단계에서는 페이스 랜드마크를 추출한다. 랜드마크는 눈, 코, 입, 눈썹 등 주요 부위의 특징점을 의미하며, Active Shape Models Dlib의 68점 모델, Hourglass Networks, 3D Morphable Models 등 다양한 방법이 활용된다[11-14]. 이러한 랜드마크는 2D뿐만 아니라, 필요에 따라 고개 움직임 등 3D 정보도 추적될 수 있다. 추적 과정에는 Optical Flow, Correlation Filters, KCF(kernelized correlation filter), Kalman 필터 등과 같은 기법이 적용된다. 추출된 랜드마크가 확보되면, 해당 랜드마크들의 움직임 변화를 기반으로 표정을 분류한다. 예를 들어, 랜드마크로 구성된 폴리곤의 면적 변화, 길이 변화, 각 랜드마크 간 상대적인 이동량 등의 특징이 측정되어 표정이 인식된다. 이를 좀 더 체계적으로 처리하기 위해 딥러닝 기반의 분석 기법과 함께 FACS(facial action coding system) 표준을 적용하는 경우가 많다[15]. FACS에서는 얼굴 근육의 움직임을 Action Unit(AU)으로 정의함으로써, 각 랜드마크 움직임이 어떤 근육의 변화와 대응되는지 체계적으로 분류할 수 있다. Meta에서는 해당 과정에서 사용된 알고리즘의 정량적 지표를 공개하지 않으나, 최종 단계에서 분석된 표정 데이터는 BlendShape 형식으로 출력된다. BlendShape은 다양한 얼굴 형태를 미리 정의하고 이를 실시간으로 조합하여 표정을 변화시키는 방식이다[16]. Meta에서는 70개 표정 데이터의 0~1 사이의 값을 제공한다. Fig. 3(a), (b), (c)는 BlendShape가 나타내는 표정 및 데이터 형식을 나타낸 것이다. 데이터는 왼쪽 눈이 열릴 때 0, 감길 때 1로 표현되며, 0과 1 사이의 값은 눈이 감기는 정도를 표현한다.

2.2 메타휴먼과 페이스 트래킹 데이터 연동

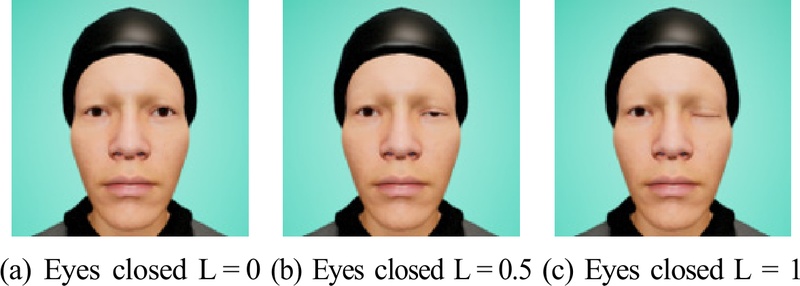

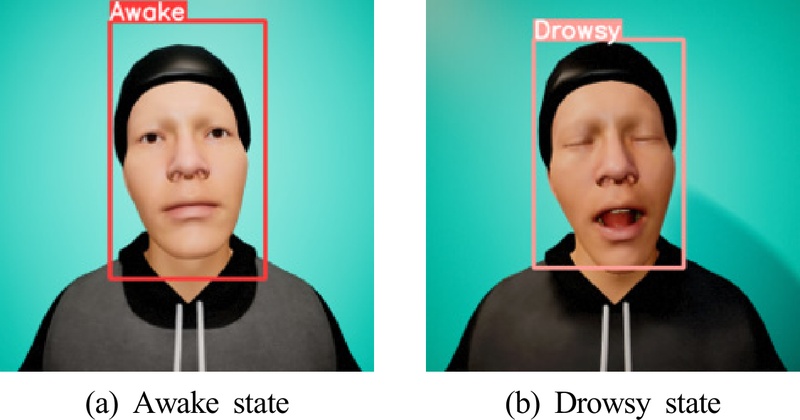

메타휴먼은 Epic Games에서 개발한 디지털 휴먼 제작 도구로, 정교한 3D 얼굴 모델과 사실적인 애니메이션 구현이 가능하다[17]. 본 연구에서는 메타휴먼과 VR HMD가 활용되어 실시간 페이스 트래킹과 자연스러운 표정 애니메이션이 구현되었다. 페이스 트래킹 데이터의 획득을 위해 메타 퀘스트 프로(Meta Quest Pro)를 활용하였다. 메타 퀘스트 프로는 내부 및 외부 적외선(IR) 카메라를 탑재하여 사용자의 얼굴을 실시간으로 감지된다. 고개가 회전하면 VR HMD가 같이 회전하게 되므로 일정하게 표정을 추적할 수 있다. 표정 데이터는 Meta에서 제공하는 전용 플러그인을 통해 추출할 수 있다. 이러한 트래킹 정보를 바탕으로, 메타휴먼에 얼굴 표정을 적용할 수 있게 된다. 페이스 트래킹 데이터를 메타휴먼에 적용할 때는 주로 BlendShape 기법이 사용된다. 이 데이터는 메타휴먼 표정 제어를 위한 Morph Targets의 입력값으로 사용된다. Morph Targets은 언리얼 엔진 내에서 BlendShape 기반 표정 변화를 지원하는 기능이다. 그러나 Meta에서 정의한 BlendShape 파라미터 명칭과 메타휴먼에서 요구하는 파라미터 명칭이 일치하지 않아 직접 적용하는 데 어려움이 있다. 이를 해결하기 위해 Meta의 플러그인은 메타휴먼의 Morph Targets 적용을 위한 Live Link 프리셋을 제공한다. Live Link는 외부 데이터 스트림을 실시간으로 엔진에 전달하는 플러그인이다. 이러한 두 기능을 결합함으로써 VR HMD에서 획득한 BlendShape 데이터를 메타휴먼에 매핑하고, 실시간으로 자연스러운 페이스 트래킹을 구현할 수 있다. Fig. 4(a)와 (b)는 각각 Awake 상태와 Drowsy 상태를 나타내며, 운전자의 표정이 메타휴먼 캐릭터에 반영되는 모습을 보여준다.

2.3 AI를 활용한 졸음 감지

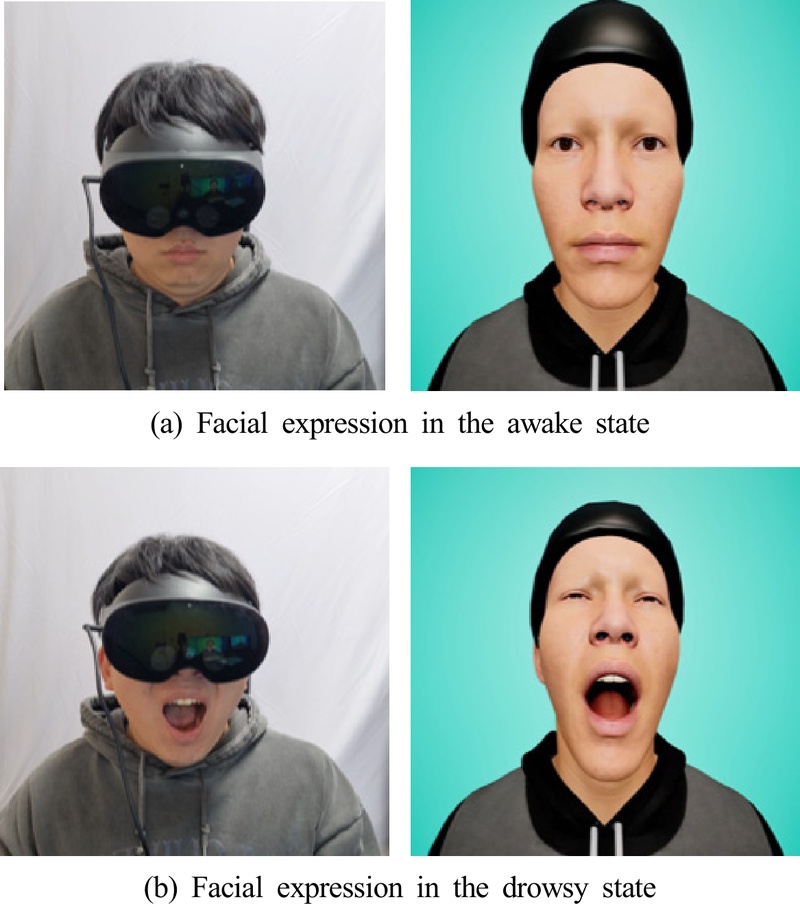

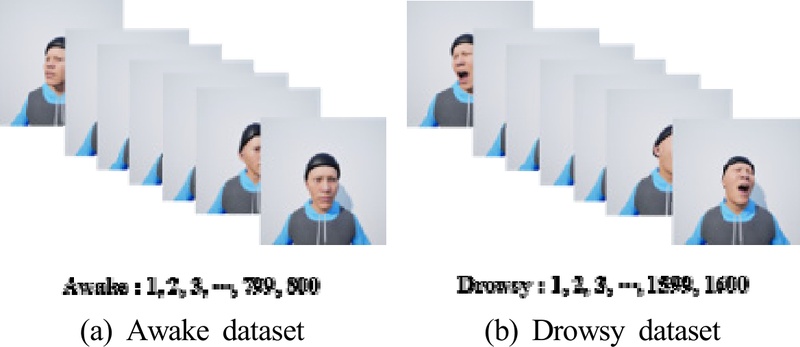

졸음 감지는 페이스 트래킹 데이터와 연동된 메타휴먼 이미지와 YOLOv5를 활용하여 운전자의 졸음 상태를 감지하는 AI 모델을 구현하였다. YOLOv5는 실시간 객체 탐지 분야에서 높은 정확도와 빠른 추론 속도를 제공하는 것으로 알려져 있다. 본 연구에서 학습에 사용된 주요 하이퍼파라미터는 Optimizer는 SGD (stochastic gradient descent), Epoch 은 1,000, Batch size는 16, 이미지 해상도는 480으로 설정되었다. Fig. 5는 YOLOv5 학습을 위해 구성된 이미지 데이터 세트이다. 페이스 트래킹과 연동된 메타휴먼 표정 이미지를 사용해 이미지 데이터 세트를 구성하였다. 데이터 세트는 Awake 상태 800장과 Drowsy 상태 1,600장 총 2,400장으로 구성되었는데, 이는 Drowsy 상태에서 발생할 수 있는 고개 떨구기, 하품, 눈 찡그리기 등의 졸음 관련 표정을 포괄하기 위함이다.

생성된 데이터 세트는 Train : Validation : Test = 6 : 2 : 2의 비율로 분할되어, 총 2,400장의 이미지 중 1,440장은 학습, 480장은 검증, 480장은 테스트에 사용되었다. 학습 신뢰도와 일반화 성능을 높이기 위해 K겹 교차 검증(K=5) 기법을 도입하여 과소 적합 및 과대 적합을 방지하였으며, 검증 단계에서 mAP(mean Average Precision)와 F1 Score 지표를 사용하였다. 그 결과, mAP는 0.994, F1 Score는 0.985로 나타나 우수한 정확도와 신뢰도를 확보하였음을 확인하였다. 객체 감지에 소요되는 시간은 20 ms 이내로 측정되어 실시간 검출에 충분한 성능을 보였다. Fig. 6은 Awake 상태와 Drowsy 상태가 검출된 결과를 나타낸다. 본 모델의 학습 및 실시간 검출에는 Intel Core i9-10940X(3.30 GHz) CPU와 NVIDIA GeForce RTX 2080 Ti GPU, 128 GB 메모리를 장착한 워크스테이션이 사용되었다.

2.4 졸음 유발 시뮬레이션 환경 제작

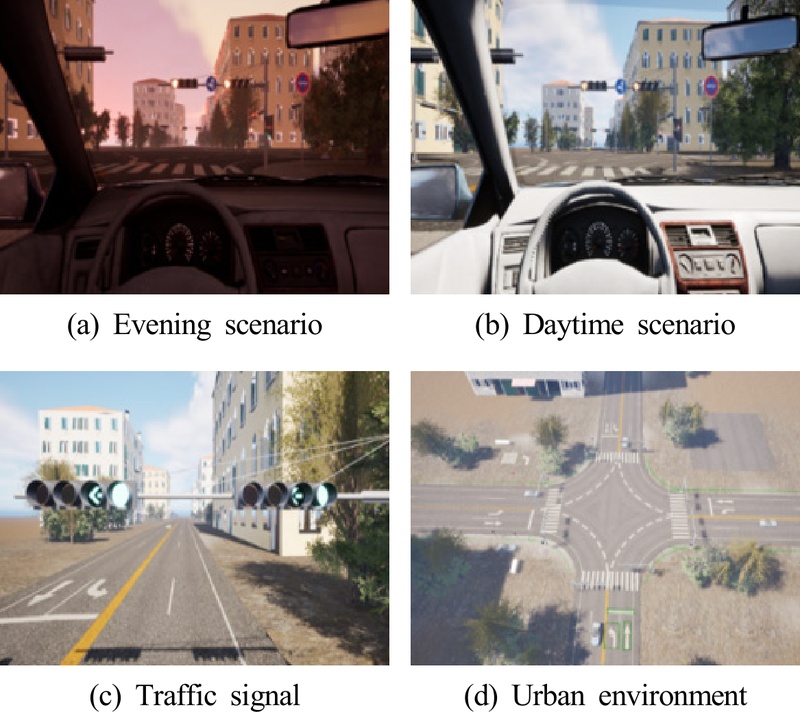

본 연구에서는 운전자의 졸음을 유발하고 이를 분석하기 위한 시뮬레이션 환경을 구축하기 위해 언리얼 엔진을 활용하였다. 언리얼 엔진은 고품질의 그래픽 및 실시간 렌더링 기능을 제공하는 게임 엔진으로, 다양한 시뮬레이션 환경을 구현하는 데 널리 사용된다[18]. Fig. 7(a), (b)에서는 타임라인 함수와 Lerp 함수를 적용하여 낮과 밤의 환경이 자연스럽게 전환되는 과정을 보여준다. 타임라인 함수는 시간에 따라 특정 변수를 제어하여 환경 변화가 부드럽게 진행되도록 한다. Lerp 함수는 두 값 사이를 0~1 범위의 Alpha 값으로 보간해 색상, 위치, 조명의 연속적 변화를 가능하게 만든다. 이를 통해 운전자의 졸음을 유도할 수 있도록 시각적 조건을 구성하였다. Fig. 7(c), (d)는 신호등과 도시 환경을 나타낸다. 반복적인 시각적 요소와 규칙적인 도시 배경을 구성하여 졸음 유발 환경을 제작하였다[19]. 신호등 및 과속방지턱, 횡단보도 등 교통 관련 요소들은 실제 운전 상황과 유사하면서도 의도적으로 단조로운 조건을 강화하여 운전자의 졸음 유발 가능성을 높이는 실험 환경을 조성하였다.

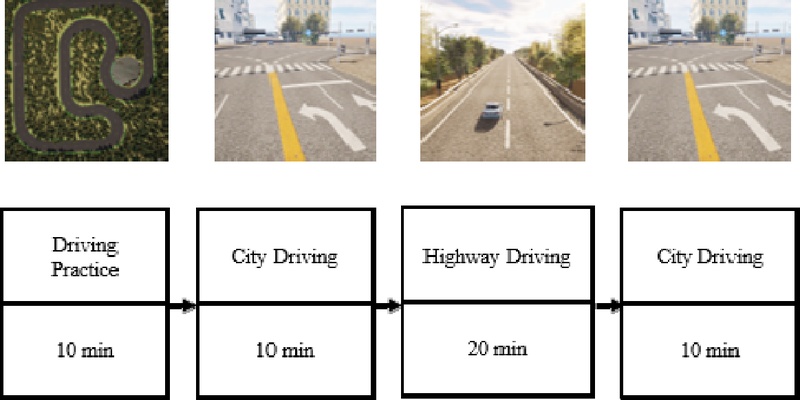

졸음 유발 시뮬레이션 환경의 실제 활용 및 효과를 검증하기 위해 Fig. 8에서는 졸음 유발 가능성이 높은 고속도로 환경과 도심 시뮬레이션 환경을 중심으로 시나리오를 구성하여 실험을 진행하였다. 운전자들은 VR 시뮬레이션 환경 적응 및 시스템 설정을 위한 연습 주행 10분, 반복적 시각 요소가 추가된 도시 시뮬레이션 환경주행 10분, 단조로운 배경의 고속도로 시뮬레이션 환경주행 20분, 누적된 졸음 상태를 고려하여 동일 조건에서 재차 주행하는 도시 시뮬레이션 환경주행 10분 순으로 주행 시나리오를 수행하였다.

결과적으로 2.4절에서 제시된 졸음 유발 환경 제작 내용은 실험에서 운전자의 졸음 상태를 관찰하고 AI 모델이 이를 실시간으로 감지하는 데 기여하였다. 도시 환경과 고속도로 환경에서 단조로움과 반복성이 운전자 졸음 유발에 미치는 영향을 분석할 수 있도록 하였다.

2.5 CO2 ppm 농도에 따른 색상 변경

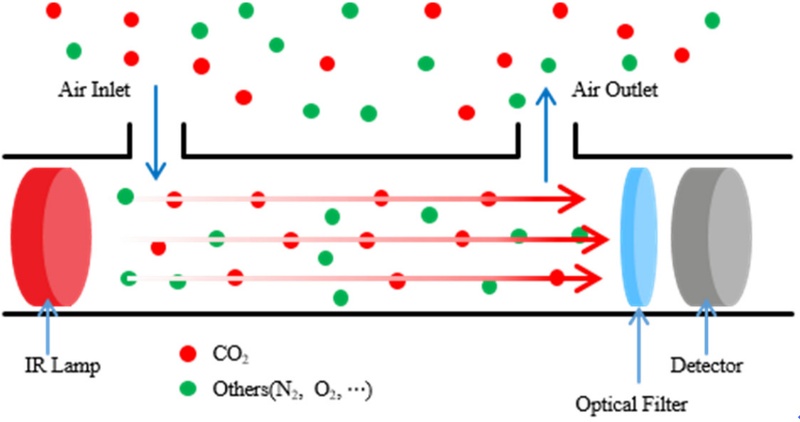

운전자의 졸음 경고 시스템을 구현하기 위해 CO2 농도를 NDIR(non-dispersive infrared) 센서를 통해 측정하고 이를 기반으로 색상을 변화시키는 방안을 제시하였다. Fig. 8은 NDIR 센서가 CO2 농도를 측정하는 그림을 나타낸다. NDIR 센서는 적외선 영역 파장 흡수 원리를 이용하여 CO2 농도를 산출한다. NDIR 센서는 적외선을 방출하고 CO2 분자가 특정 파장을 흡수하는 원리를 이용하여 CO2 농도를 추정한다. 4.26 μm 파장은 CO2 분자가 흡수하는 영역이며, 4.26 μm 파장만 광학 필터(optical filter)를 통과할 수 있다. CO2 농도가 높아질수록 흡수량은 증가되고, 광학 필터를 지나 감지기에 도달하는 4.26 μm 파장의 변화를 계측하여 농도를 산출한다. 센서에서 측정된 CO2 농도 데이터는 언리얼 엔진으로 전송되어 운전자에게 농도 수치와 시각적 경고를 제공한다.

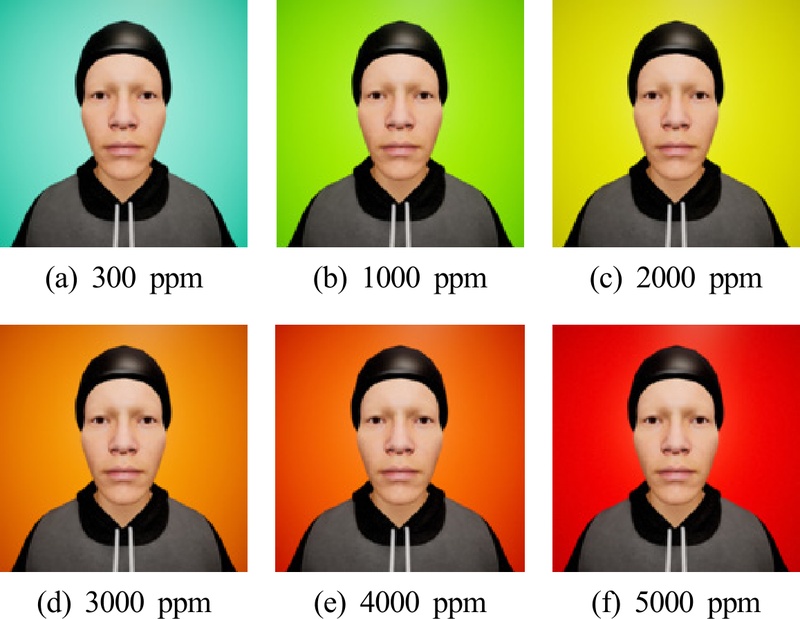

본 시스템에서는 CO2 농도를 0~5,000 ppm 구간으로 설정하고, 각 구간별로 고유한 색상을 나타내도록 구현하였다. 국제화학물질안전카드(ICSC) 0021에서 CO2 농도 5,000 ppm을 근로자 시간가중평균(TWA) 노출 한도로 명시한 점을 바탕으로 5,000 ppm을 최대 측정값으로 설정하였다[20]. 또한, 기존 연구에서 2,000 ppm 이상이 되면 인지 기능이 급격히 저하되고 졸음 유발 확률이 높아진다는 결과를 토대로, 0~2,000 ppm 구간에서는 청색 계열에서 황색 계열로 색상이 변하고, 2,000~3,000 ppm 구간에서는 황색에서 주황색, 3,000~5,000 ppm 구간에서는 주황색에서 적색으로 점차 경고가 강화되도록 표시하였다. Fig. 10(a)-(f)는 ppm농도가 각각 300 ppm, 1,000 ppm, 2,000 ppm, 3,000 ppm, 4,000 ppm, 5,000 ppm일 때 배경색의 변화를 나타낸 것이다.

이러한 색상 전환은 언리얼 엔진의 선형 보간 함수를 사용하여 구현하였다. 우선 ppm 값을 0에서 최대치 5,000 ppm으로 리스케일링한 뒤, 해당 값을 0~1 범위로 변환하여 Lerp 함수의 Alpha 값으로 사용함으로써 자연스럽게 색상을 보간할 수 있다. 이 과정에서 적색(R) 값이 증가하고 청색(B) 값이 동시에 감소할 때, 일부 구간에서 색상이 예상보다 밝아지거나 흰색에 가까워지는 현상을 완화하기 위해, 중간 계열 색상인 녹색을 추가하여 부드러운 색상 변화를 유도하였다.

3. 시스템 시뮬레이션

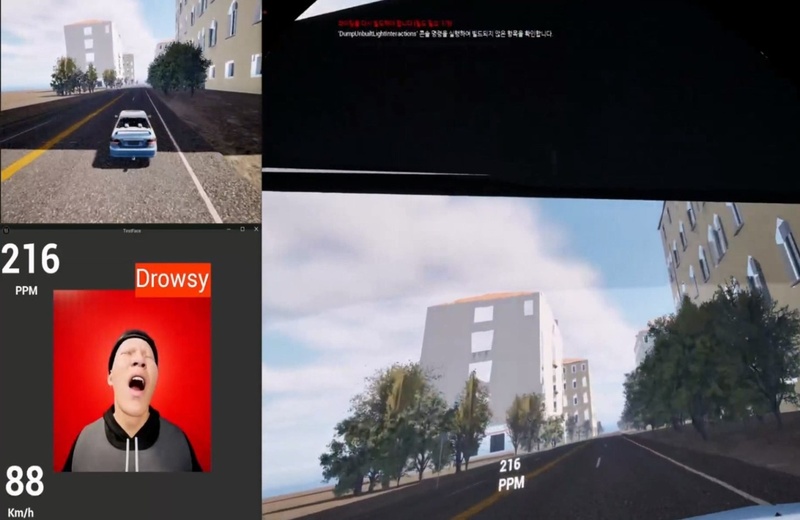

본 시뮬레이션은 Fig. 11과 같이 VR 운전자를 모니터링할 수 있는 환경으로 구성되었다. VR 운전자의 상태를 실시간으로 확인할 수 있도록 시스템이 설계되었으며, 1인칭 및 3인칭 시점과 메타휴먼 위젯 화면을 통해 모니터링이 가능하도록 제작되었다. 시스템은 졸음 유발 환경, 페이스 트래킹, CO2 감지 장치를 통합하여 구성되었다. AI 모델은 졸음 상태를 탐지하며, 졸음 상태가 3초 이상 지속되면 경고를 제공한다. 경고는 색상 변화와 함께 소리로도 전달되어 운전자에게 즉각적인 피드백을 제공한다. Fig. 11에서는 졸음이 탐지되었을 때 CO2 농도와는 상관없이 메타휴먼 배경 색상이 붉게 변하는 모습을 확인할 수 있다.

4. 결 론

본 연구에서는 페이스 트래킹과 AI 기반 운전자 졸음 감지 시스템을 개발하고 이를 시뮬레이션 환경에 통합하였다. 시뮬레이션 환경은 도로 조건, 주변 배경, 조명 등 다양한 환경 변수를 조절할 수 있어 실험 조건을 정밀하게 설정하는 데 유리하며, 운전자의 몰입도를 높이고 실제 운전 상황과 유사한 환경을 제공하기 위해 VR HMD를 활용하였다. 이를 통해 운전자의 졸음 변화를 관찰할 수 있는 실험 환경을 구축하였다. 제안된 시스템은 시뮬레이션 환경에서 운전자의 실시간 졸음 상태를 감지하고, CO2 농도가 2,000 ppm 이상이거나 졸음 상태로 분류되면 시각적・청각적 경고를 제공하여 시뮬레이션 환경에서 졸음 감지 기능이 유효하게 작동하여 운전자의 주의 환기에 도움이 될 가능성을 확인하였다. 또한, 경고 후 운전자의 즉각적인 대응이 이루어지지 않는 상황을 고려하여 단계별 경고음, 가속 페달 제어 등의 새로운 피드백 방식 도입의 필요성을 확인하였다. 시뮬레이션 환경에서 운전자의 주행 패턴 및 반응을 관찰하고 기록할 수 있는 기반을 마련하였다.

향후 연구에서는 전방 주시 태만, 휴대폰 사용, 안전띠 미착용 등 위험 운전 행동을 감지하는 기능을 추가하고, 시계열 데이터 분석을 활용하여 AI 모델의 정확도 및 실시간 경고 체계의 효율성을 향상할 계획이다. 또한, 경고 미이행 시 발생할 수 있는 위험을 최소화하기 위해 자동 긴급 제동 시스템 및 차로 이탈 방지 시스템과의 연동 가능성을 모색할 것이다. 이를 통해 운전 중 발생할 수 있는 위험 요소를 종합적으로 모니터링하고 운전자 행동 변화를 정량적으로 분석함으로써 시뮬레이션 결과를 토대로 실제 도로 주행 시 적용 가능한 안전 대책을 마련하는 데 기여하고자 한다.

Acknowledgments

본 연구는 2024년도 교육부의 재원으로 한국연구재단의 지원을 받아 수행된 지자체-대학 협력기반 지역혁신 사업의 연구(2022RIS-005) 및 강원대학교 산업기술연구소의 지원을 받은 연구입니다.

References

- Korean National Police Agency, 2024, viewed 27 November 2024, Beware of Drowsy Driving in Spring, <https://www.police.go.kr/user/bbs/BD_selectBbs.do?q_bbsCode=1002&q_bbscttSn=20240404142330339&q_tab=&q_searchKeyTy=sj___1002&q_searchVal=%EB%B4%84%EC%B2%A0%20%EB%B6%88%EC%B2%AD%EA%B0%9D&q_rowPerPage=10&q_currPage=1&q_sortName=&q_sortOrder=&, >.

-

Satish, U., Mendell, M. J., Shekhar, K., Hotchi, T., Sullivan, D., Streufert, S., Fisk, W. J., 2012, Is CO2 an Indoor Pollutant? Direct Effects of Low-to-Moderate CO2 Concentrations on Human Decision-Making Performance, Environ. Health Perspect., 120:12 1671-1677.

[https://doi.org/10.1289/ehp.1104789]

-

Ji, Q., Zhu, Z., Lan, P., 2004, Real-Time Nonintrusive Monitoring and Prediction of Driver Fatigue, IEEE Transactions on Vehicular Technology, 53:4 1052-1068.

[https://doi.org/10.1109/TVT.2004.830974]

-

Patel, M., Lal, S. K. L., Kavanagh, D., Rossiter, P., 2011, Applying Neural Network Analysis on Heart Rate Variability Data to Assess Driver Fatigue, Expert Syst. Appl., 38:6 7235-7242.

[https://doi.org/10.1016/j.eswa.2010.12.028]

-

Lin, C.-T., Huang, K.-C., Chao, C.-F., Chen, J.-A., Chiu, T.-W., Ko, L.-W., Jung, T.-P., 2010, Tonic and Phasic EEG and Behavioral Changes Induced by Arousing Feedback, NeuroImage, 52:2 633-642.

[https://doi.org/10.1016/j.neuroimage.2010.04.250]

-

Tashakori, M., Nahvi, A., Ebrahimian, Kiashari, S. E. H., 2021, Driver Drowsiness Detection Using Facial Thermal Imaging in a Driving Simulator, Proc. Inst. Mech. Eng. Part H-J. Eng. Med. 236:1 43-55.

[https://doi.org/10.1177/09544119211044232]

-

Viola, P., Jones, M., 2001, Rapid Object Detection Using a Boosted Cascade of Simple Features, Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR 2001), 511-518.

[https://doi.org/10.1109/CVPR.2001.990517]

-

Dalal, N., Triggs, B., 2005, Histograms of Oriented Gradients for Human Detection, 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR'05), 886-893.

[https://doi.org/10.1109/CVPR.2005.177]

-

Zhang, K., Zhang, Z., Li, Z., Qiao, Y., 2016, Joint Face Detection and Alignment using Multitask Cascaded Convolutional Networks, IEEE Signal Processing Letters, 23:10 1499-1503.

[https://doi.org/10.1109/LSP.2016.2603342]

-

Deng, J., Guo, J., Ververas, E., Kotsia, I., Zafeiriou, S., 2020, RetinaFace: Single-shot Multi-Level Face Localisation in the Wild, 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 5203-5212.

[https://doi.org/10.1109/CVPR42600.2020.00525]

-

Cootes, T. F., Taylor, C. J., Cooper, D. H., Graham, J., 1995, Active Shape Models—Their Training and Application, Comput. Vis. Image Underst., 61:1 38-59.

[https://doi.org/10.1006/cviu.1995.1004]

-

Kazemi, V., Sullivan, J., 2014, One Millisecond Face Alignment with an Ensemble of Regression Trees, 2014 IEEE Conference on Computer Vision and Pattern Recognition, 1867-1874.

[https://doi.org/10.1109/CVPR.2014.241]

-

Newell, A., Yang, K., Deng, J., 2016, Stacked Hourglass Networks for Human Pose Estimation, 14th European Conference Computer Vision-ECCV2016, 483-499.

[https://doi.org/10.1007/978-3-319-46484-8_29]

-

Blanz, V., Vetter, T., 1999, A Morphable Model for the Synthesis of 3D Faces, Proc. 26th Annu. Conf. Comput. Graph. Interactive Tech. (SIGGRAPH), 187-194.

[https://doi.org/10.1145/311535.311556]

-

Ekman, P., Friesen, W. V., 1978, Facial Action Coding System, Environmental Psychology & Nonverbal Behavior.

[https://doi.org/10.1037/t27734-000]

-

Lewis, J. P., Anjyo, K., Rhee, T., Zhang, M., Pighin, F. H., Deng, Z., 2014, Practice and Theory of Blendshape Facial Models, Eurographics Conference (State of the Art Reports), 1(8), 2, 199-218.

[https://doi.org/10.2312/egst.20141042]

- Epic Games, n.d., viewed 5 December 2024, MetaHuman Documentation, <https://dev.epicgames.com/documentation/en-us/metahuman/metahuman-documentation, >.

- Epic Games, n.d., viewed 5 December 2024, Unreal Engine Official Website, <https://www.unrealengine.com/ko, >.

-

Larue, G. S., Rakotonirainy, A., Pettitt, A. N., 2011, Driving Performance Impairments Due to Hypovigilance on Monotonous Roads, Accid. Anal. Prev., 43:6 2037-2046.

[https://doi.org/10.1016/j.aap.2011.05.023]

- International Labour Organization (ILO) and World Health Organization (WHO), 2024, viewed 10 December 2024, Carbon Dioxide (ICSC: 0021), <https://chemicalsafety.ilo.org/dyn/icsc/showcard.display?p_card_id=0021&p_version=2&p_lang=en, >.

M.Sc. Candidate in the Department of Mechanical Convergence Engineering, Major in Mechatronics Engineering, Kangwon National University. His research interest is Digital Twin of Machine Tool.

E-mail: american33@kangwon.ac.kr

Ph.D. Candidate in the Department of Mechanical Convergence Engineering, Major in Mechatronics Engineering, Kangwon National University. His research interest is Mechanical Engineering and AI.

E-mail: ccm516@kangwon.ac.kr

Ph.D. Candidate in the Department of Smart Health Science and Technology, Kangwon National University. His research interest is Mechanical Engineering.

E-mail: js_of_yadang@kangwon.ac.kr

Professor in the Department of Smart Health Science and Technology, Kangwon National University. His research interest is Micro/Nanoscale Surface Texturing Technologies and their Applications in Various Sensor Systems.

E-mail: mems@kangwon.ac.kr

Professor in the Department of Smart Health Science and Technology, Kangwon National University. His research interest is Micro and Nano System Design and Precision Control of Machine Tools.

E-mail: kbh@kangwon.ac.kr