실외 청소 로봇을 위한 자율주행 시스템 개발

Abstract

The demand for maintaining outdoor recreational spaces, such as urban parks and bicycle roads, is increasing, but municipalities are facing limitations in terms of manpower and budgets. To address these challenges, this study develops an autonomous driving system for outdoor cleaning robots by converting existing manned cleaning machines into unmanned platforms. The proposed system integrates environmental perception, path planning, and motion control using sensors, such as RTK-GPS, LiDAR, ultrasonic sensors, and cameras. The proposed system is applied to a conventional cleaning robot and tested via trial operations in an urban park. The results demonstrate that the robot can autonomously navigate designated cleaning routes while accurately detecting obstacles and maintaining safe operations. This study highlights the potential of autonomous outdoor cleaning robots to improve urban sanitation services and reduce labor dependency, especially as regulatory barriers to robot deployment are gradually easing.

Keywords:

Autonomous outdoor cleaning robot, GPS-vision hybrid navigation, Heading angle control, Waypoint-based path tracking, Centerline detection using CNN1. 서 론

최근 들어 근린 공원, 도시 숲, 산책로, 자전거 도로 등 시민 복지 향상을 위한 실외 공간이 지속적으로 확장되고 있다. 이에 따라 이러한 공간의 청결 유지에 대한 수요가 증가하고 있지만, 지방자치단체는 한정된 예산과 인력 문제로 효율적인 관리를 수행하는 데 어려움을 겪고 있다. 특히 환경미화원의 2교대 근무 여건 개선 요구와 근무 외 시간대에 발생하는 청소 공백 문제로 인해, 기존 방식만으로는 시민들의 쾌적한 환경 요구를 만족시키기 어려운 상황이다.

자율주행 기술의 발전으로 실내 청소 로봇은 이미 상용화 단계에 진입했으나, 실외 환경에 적용 가능한 청소 로봇은 기술적 성숙도와 법·제도적 기반이 미비하여 보급이 제한적인 상황이다.『공원녹지법』에 따라 자율주행 로봇의 도시공원 진입은 2024년까지 금지되어 있었으며, 자율주행 로봇에 탑재된 카메라 등 이동형 영상처리 장치의 활용 역시 개인영상정보 보호 원칙에 따라 제한을 받아왔다. 그러나 2024년에 공포된 ‘개인영상정보 보호 활용 기준’은 이러한 영상처리 장치의 운용에 대한 명확한 기준을 제시함으로써, 기존에는 특례지구에서만 가능했던 자율주행 로봇의 활용을 일반 지역으로도 확대할 수 있는 제도적 기반을 마련하였다.

한편, 해외에서는 핀란드 헬싱키의 ‘트롬비아 프리(Trombia Free)’와 중국 창저우시의 ‘워샤오바이(蜗小白)’와 같은 실외 자율주행 청소 로봇[1-3]이 실제 도심 환경에서 운용되기 시작했으며, 국내에서도 관련 법규의 개정을 통해 실외 자율주행 청소 로봇은 도로 청소, 공공 시설물 유지, 잡초 제거 등 다양한 작업을 자동화할 수 있어, 인력 부족 문제를 해소하고 작업 효율을 향상시키는 데 기여할 수 있다.

본 연구에서는 기존 유인 청소 로봇을 기반으로, 무인화를 위한 자율주행 요소 기술(환경 인식, 주행 판단, 경로 제어)을 통합하여 실외 청소 로봇 시스템을 구축하였다. 주요 구성 요소로는 구동 및 조향 제어 시스템, 카메라, RTK-GPS, LiDAR, 초음파 센서 등을 사용하였으며, 개발된 시스템을 도심 공원에서 시범 운용하여 무인 청소 성능을 검증하였다.

2. 청소 로봇 구성

2.1 청소 로봇 기반 하드웨어 수정

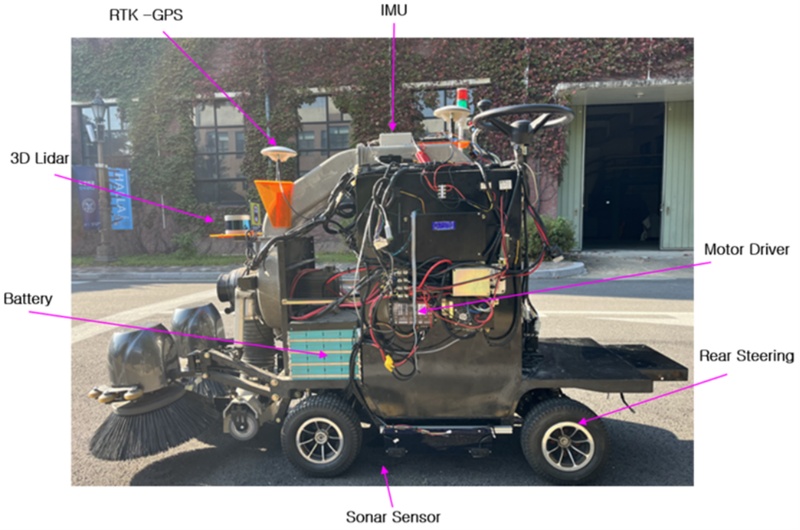

기존 유인형 청소 로봇을 자율주행이 가능한 무인 시스템으로 전환하기 위하여 하드웨어를 전반적으로 수정하였다. Fig. 1과 같이 청소 로봇은 기본적으로 구동축과 조향축을 갖춘 구조였으나, 자율주행 기능을 부여하기 위해 구동 제어, 조향 제어, 위치 인식, 주변 인식 기능이 추가적으로 요구되었다.

먼저, 구동축에는 48 V 전압을 사용하는 BLDC 모터를 장착하여 청소 로봇의 추진력을 담당하도록 하였다. 이 모터는 고해상도 인코더(512 pulse/rev)를 통해 실시간 속도 및 이동 거리 정보를 측정할 수 있도록 구성하였으며, 모터 제어기는 RS-485 통신 기반으로 임베디드 제어기와 연동되어 정밀한 속도 제어와 방향 제어를 수행한다. 구동축에는 최종 감속비 30:1의 감속기를 부착하여 실외 경사 및 장애물 주행 시 안정적인 추진력을 확보하였다.

조향축은 Ackermann steering[4]방식으로 설계되었으며, 기존 수동 조향 시스템을 스텝핑 모터와 각도 센서를 활용하는 전동식 조향 시스템으로 수정하였다. 조향각은 중앙 0도를 기준으로 ±27o 범위에서 제어가 가능하며, 조향각 오차를 보정하기 위해 방향각(heading angle)[5] 제어 알고리즘을 별도로 개발하였다.

또한, 실외 자율주행을 위해 고정밀 위치 인식을 위한 RTK-GPS 모듈과 GNSS 안테나를 상부에 설치하였다. 주변 장애물 인식을 위해 전방에는 3D LiDAR 센서를, 측방과 후방에는 초음파 센서를 장착하였다. 로봇 전면에는 global shutter 카메라를 설치하여 실시간 영상 인식 및 주행 경로 판단에 활용하였다.

전체 하드웨어 시스템은 ATmega2560 기반 임베디드 제어기와 embedded PC로 구성되어 있으며, 센서 데이터 수집, 구동/조향 모터 제어, 경로 판단 및 주행 명령 생성이 효율적으로 이루어지도록 설계하였다. Table 1에 H/W 수정에 대하여 요약하였다. 이러한 하드웨어 수정 작업을 통해 기존 청소 로봇의 청소 기능을 유지하면서도, 외부 환경 인식, 경로 추종, 장애물 회피 등이 가능한 무인 자율주행 시스템으로 전환할 수 있었다.

2.2 센서 시스템 설계

실외 환경에서 청소 로봇의 안정적인 자율주행을 구현하기 위하여 다양한 센서 기반 시스템을 설계하였다. 로봇의 위치 인식, 장애물 탐지, 환경 인식 기능을 담당하는 각 센서들은 실시간 데이터 수집과 처리에 최적화되도록 배치되었다.

자율주행을 위한 절대 위치 인식을 위하여 고정밀 Real-Time Kinematic(RTK) GPS 시스템을 적용하였다. 사용된 RTK-GPS 모듈은 ±2 cm 이내의 위치 정밀도를 제공하며, Global Navigation Satellite System (GNSS) 안테나를 통한 고정밀 신호 수신이 가능하다. 위치 데이터는 10 Hz의 주기로 업데이트되며, 임베디드 제어기로 실시간 전송되어 주행 경로 추종 및 위치 보정에 활용된다. RTK-GPS는 로봇의 절대 좌표를 제공하여 경유점(waypoint) 기반 주행 제어에 핵심적인 역할을 수행한다.

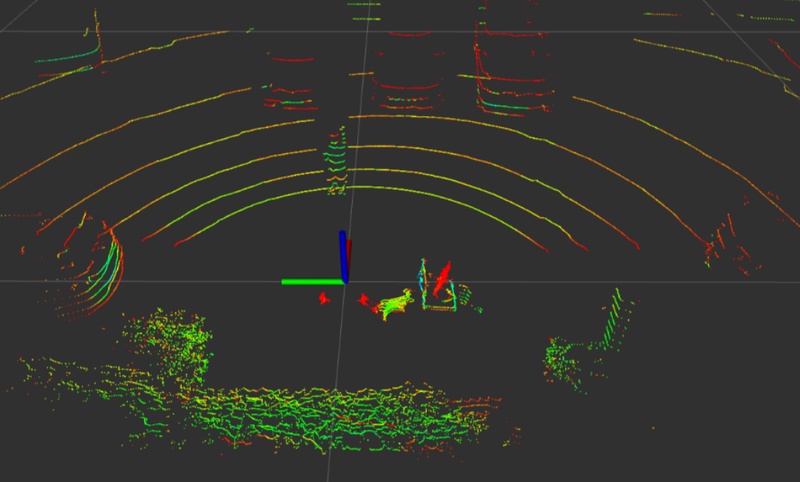

주변 장애물 탐지 및 충돌 방지를 위해 Robosense사의 16채널 3D LiDAR와 초음파 센서를 조합하여 사용하였다. 3D LiDAR는 로봇 전방에 설치되어 Fig. 2와 같이 보행자, 벤치, 가로수 등 다양한 크기의 장애물을 실시간으로 감지하며, 포인트 클라우드(point cloud) 데이터를 통해 주변 지형을 3차원적으로 인식한다.

보완적으로, Fig. 3에 나타난 바와 같이 초음파 센서는 전방, 측방, 후방에 각각 배치되어 근거리 장애물 탐지 기능을 강화하였다. 초음파 센서는 각각 최대 4.5 m 거리까지 감지가 가능하며, 좁은 길과 경계석과 같은 복잡한 환경에서도 장애물을 인식하는 데 기여한다. 또한, 청소 영역의 경계나 인접 장애물과의 안전 거리를 유지하는 데 중요한 역할을 한다.

청소 로봇의 경로를 동적으로 인식하고 조정하기 위해 전방에 HIK Robot사의 CE Serise의 global shutter 방식의 카메라를 설치하였다. 카메라는 Fig. 4와 같이 주행 중 보행로의 형태, 사람, 장애물, 쓰레기 등 다양한 객체를 실시간으로 촬영하고, 인공지능 기반 영상 처리 알고리즘(CNN, YOLO 등)을 통해 주요 객체를 인식한다.

그리고, GPS 신호가 불안정하거나 수신 불가한 구역에서는 카메라 영상 데이터를 활용하여 보행로 중심선 추출 및 경로 보정 작업을 수행한다. 영상 기반 중심선 인식은 기존의 위치 정보와 융합되어, 더욱 안정적인 자율주행을 가능하게 한다.

RTK-GPS 신호가 불안정하거나 단절되는 상황에서도 안정적인 위치 추정을 가능하게 하기 위해, Inertial Measurement Unit (IMU)와 wheel encoder를 이용한 Odometry 시스템[6]을 추가 설계하였다.

IMU는 9축 센서를 사용하여 로봇의 3축 가속도와 3축 각속도, 지자기 정보를 측정하며, 이를 통해 실시간으로 자세(roll, pitch, yaw) 및 방향(heading angle)을 추정한다. 특히, 주행 중 heading angle 변화를 지속적으로 보정하여 경로 추적 성능을 향상시킨다.

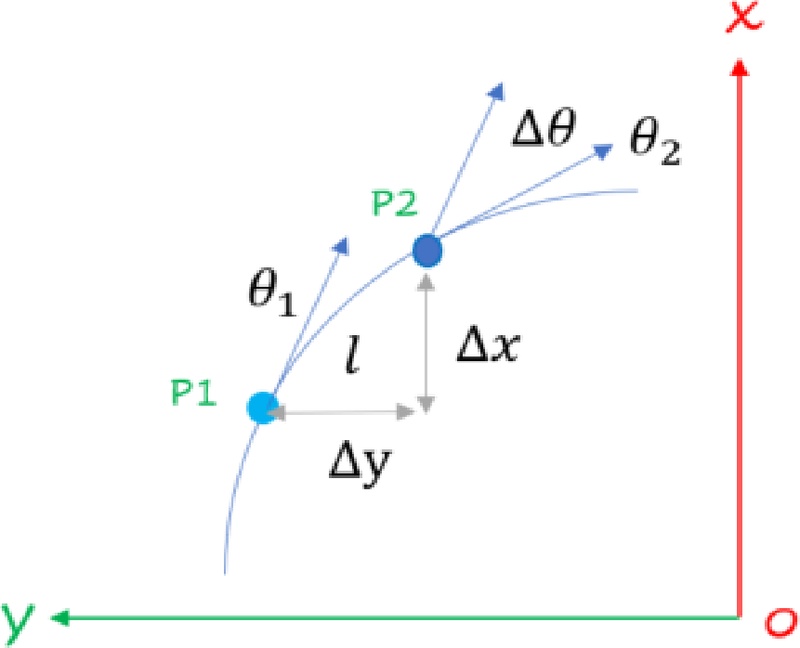

Wheel encoder는 각 구동축에 장착되어 바퀴의 회전수를 측정하고, 이를 기반으로 이동 거리 및 주행 방향 변화를 계산한다. 로봇이 곡선 경로를 따라 주행할 때, Fig. 5와 같이 이동 거리와 변위는 다음과 같은 수식을 통해 계산된다.

| (1) |

| (2) |

여기서, 𝑙은 바퀴가 이동한 호의 길이, 𝑟은 회전 반경(radius), Δ𝜃 회전한 각도(rad)이다. Δ𝑥,Δ𝑦 는 각각 x축, y축 방향으로의 상대 변위를 의미한다.

2.3 조향 제어 시스템 및 Heading angle 기반 제어

청소 로봇의 조향 시스템으로 후륜 Ackermann steering 방식을 적용하였다. 조향 구동은 엔코더가 부착된 스텝핑 모터를 이용하여 구성되었으며, 중앙(0o) 및 좌측 한계(-27o) 위치에 리미트 스위치를 설치하여 조향 범위를 설정하였다. 조향 제어는 중앙 0o를 기준으로 -27o부터 +27o까지의 조향각이 가능하도록 설계되었으며, PID 제어를 통해 각도 위치 제어를 수행하였다.

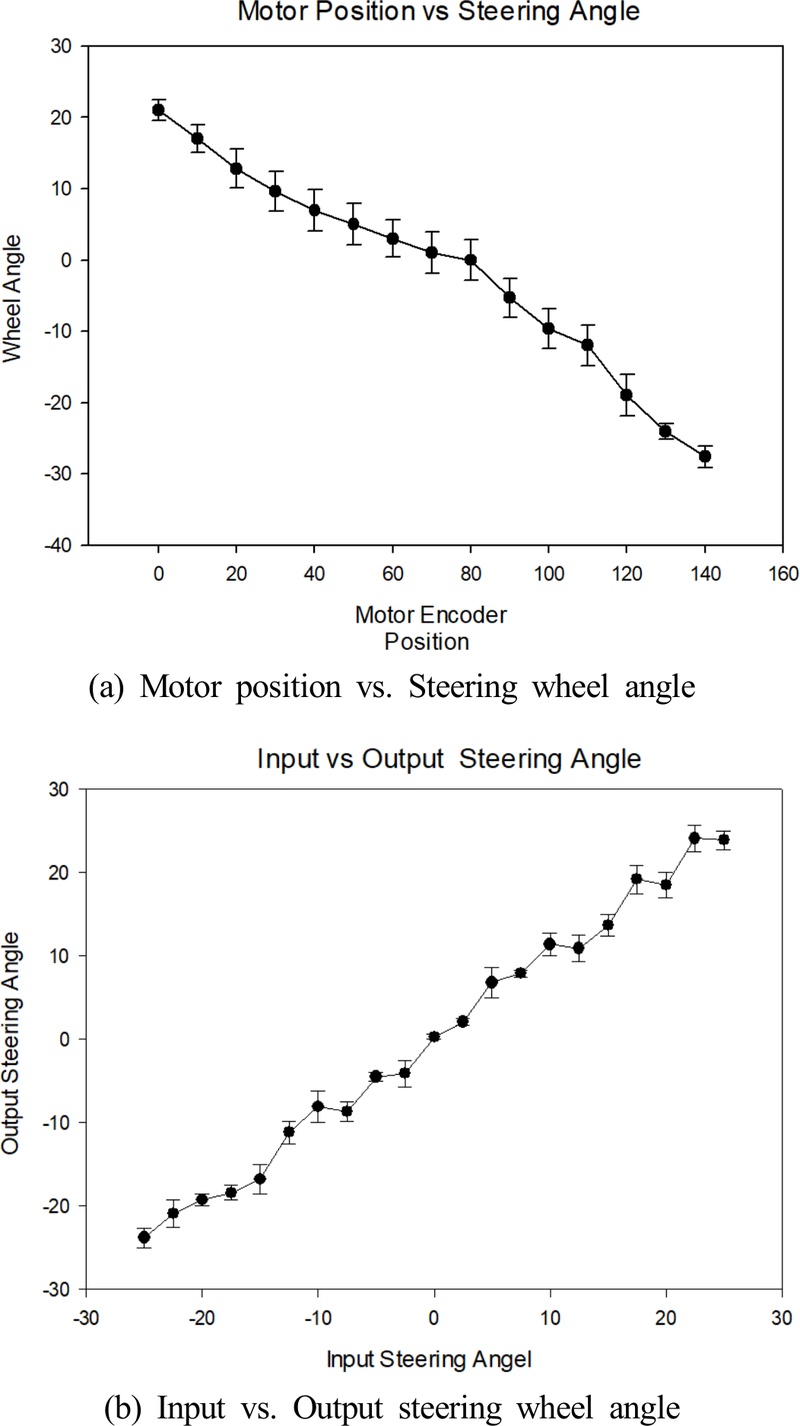

조향 장치의 제어 성능을 평가하기 위해 모터 위치와 휠의 실제 조향 각도 간 관계를 실험적으로 분석하였다. Fig. 6에 실험 결과를 나타내었으며, 조향 모터의 명령 위치와 실제 휠 조향각 사이에 약 ±2.75o의 오차가 존재하는 것을 확인하였다.

이러한 기구적 오차는 로봇의 횡방향 제어 정확도에 직접적인 영향을 미치며, 특히 정밀 주행이 필요한 청소 작업에서는 큰 제약 요인이 된다. 고가의 정밀 조향 시스템을 적용하는 것은 비용 측면에서 현실적이지 않으므로, 본 연구에서는 일반적인 Stanley[7]와 같은 직접 조향각(steering angle)을 조정하는 대신 로봇 전체의 방향각(heading angle)을 제어하는 방식을 제안하였다.

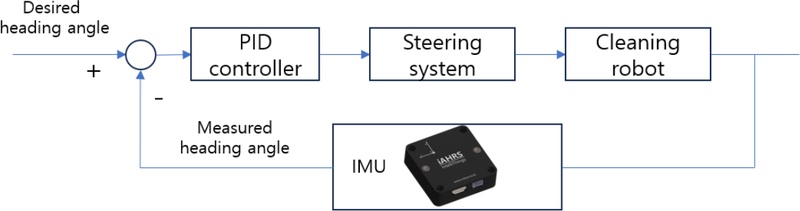

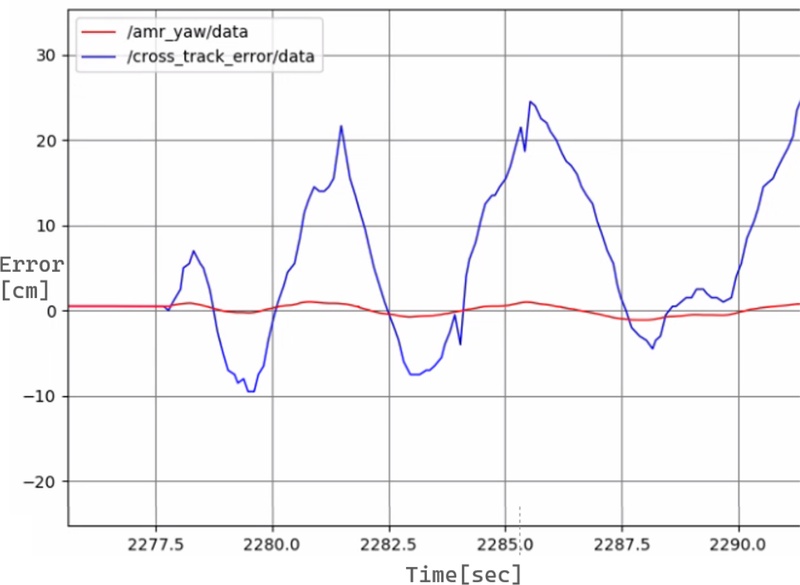

Heading angle 제어는 IMU 센서로 측정한 현재 로봇 방향과 목표 방향(desired heading angle) 간 오차를 계산하고, 이를 기반으로 조향 명령을 생성하는 방식으로 구성되었다. Fig. 7은 제안한 heading angle 제어 시스템의 구성도를 나타낸다. Heading angle 제어를 적용한 결과는 Fig. 8에 나타내었다. 빨간색은 yaw angle 오차, 파란색은 cross track error를 나타내었다. 제어 결과, 목표 방향에 대한 평균 오차는 ±3.2o 이내로 유지되었으며, cross track error는 ±7.5 cm이하이다. 이는 청소 로봇의 실외 주행에서 요구되는 허용 오차 범위 내임을 확인할 수 있었다.

3. 자율주행 경로 제어

3.1 GPS waypoint 기반 경로 제어

실외 청소 로봇이 지정된 청소 구역을 안정적으로 주행할 수 있도록 GPS waypoint 기반 경로 추종 알고리즘을 개발하였다. Waypoint 기반 주행은 사전에 설정된 경유점(waypoints)을 순차적으로 추종하여 로봇이 전체 주행 경로를 완성하도록 하는 방식이다[8].

경로 학습 과정에서는 RTK-GPS를 활용하여 청소 대상 지역 내 보행로의 중심선 또는 주요 이동 경로를 따라 waypoint 데이터를 수집하였다. 수집된 각 waypoint는 Universal Transverse Mercator (UTM) 좌표계 기준으로 변환 및 저장되었으며, 인접 waypoint 간의 거리는 1~2 m 간격으로 설정하여 경로의 부드러운 연결성을 확보하였다.

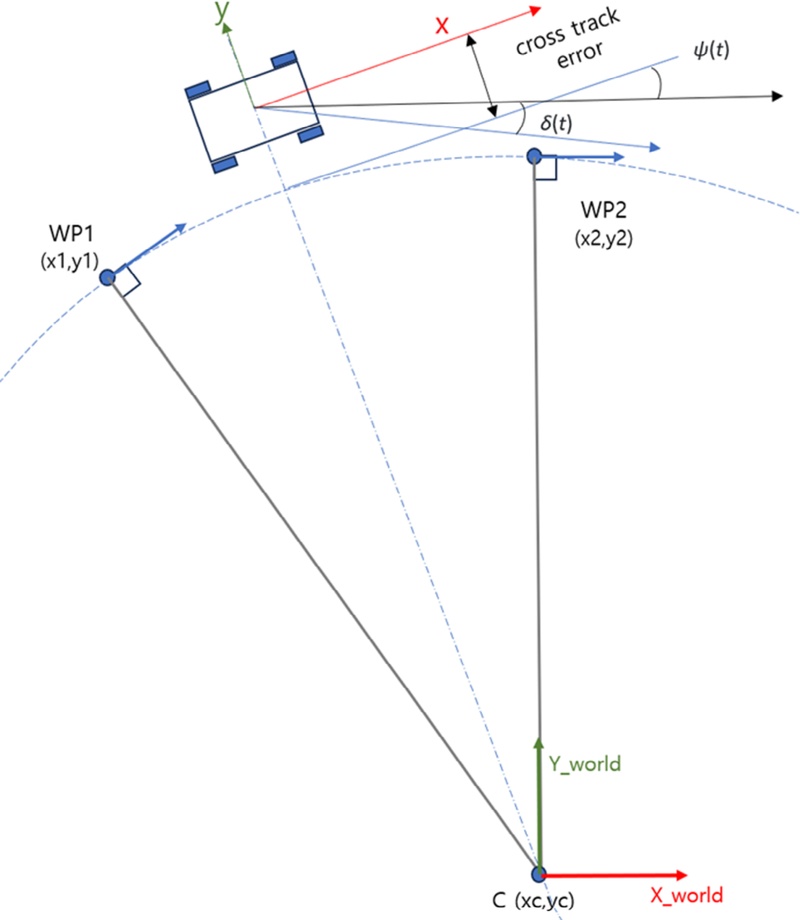

로봇은 실시간으로 RTK-GPS를 통해 현재 위치를 수신하고, 가장 가까운 waypoint를 목표로 설정한다. 주행 제어는 Fig. 9와 같이 차량의 현재 위치와 목표 경로(WP1, WP2)를 기반으로 Cross Track Error(CTE) 및 heading error를 계산하고, 이를 이용해 방향을 제어하는 방식으로 수행된다. Cross Track Error ec는 식 (3)과 같이 정의 된다.

| (3) |

여기서, (x, y)는 차량의 현재 위치, (x℘, y℘)는 최근접 waypoint의 위치, ψ℘는 최근접 waypoint 위치, ψ(t)는 waypoint 경로의 방향(heading)이다. Heading error θc는 다음 식 (4)와 같이 정의된다.

| (4) |

차량은 heading error와 Cross Track Error를 보정하여 주행 경로를 유지하도록 제어된다. 본 연구에서는 조향 시스템의 기구적 한계를 고려하여, steering angle을 직접 제어하는 대신에, 식(5)와 같이 heading angle 오차 ∆θ를 최소화 하는 방향으로 제어를 수행하였다.

| (5) |

| (6) |

조향 기구의 구조적인 백래시(backlash)와 오차로 인해 미세한 조향각 제어는 어렵기 때문에, Stanley 제어 방식이나 Pure Pursuit 방법과 같은 정밀한 steering angle 제어는 적용하지 않고 heading angle을 직접 제어하는 방식을 채택하였다.

주행 중 로봇이 목표 waypoint에 도달한 것으로 판정되면, 다음 waypoint로 자동 전환하여 연속적인 경로 추적이 가능하다. Waypoint 도달 판정은 거리 오차가 일정 임계값(예: 0.2 m 이하) 내에 들어올 경우로 정의하였다. 또한, 이동 방향(heading angle) 차이도 함께 고려하여 경로 이탈을 최소화하도록 보완하였다.

실외 환경 특성상 RTK-GPS 신호가 수신 불안정하거나 수신 불가 상태가 발생할 수 있다. 이 경우를 대비하여, 본 연구에서는 IMU 및 wheel encoder 기반의 odometry 시스템과 함께, AI 기반 비전 센서를 통한 보행로 중심선 인식 알고리즘을 병행하여 사용하였다. 비전 기반 경로 인식 결과는 odometry와 융합되어 로봇의 상대 위치를 지속적으로 추정하며, GPS 신호가 복구되면 다시 절대 위치 기반 경로 추종으로 전환된다. 이를 통해 다양한 실외 환경에서도 로봇의 경로 추종 안정성과 연속성을 확보할 수 있도록 설계하였다.

3.2 AI vision 기반 경로 제어

실외 청소 로봇의 안정적인 주행을 지원하기 위해, GPS 기반 경로 추종 외에도 비전(vision) 기반 보행로 중심 추출 알고리즘을 개발하였다. 특히, GPS 신호가 불안정하거나 수신이 불가능한 지역(나무 그늘, 고층 건물 주변 등)에서도 자율주행이 가능하도록 영상 인식을 통한 경로 추정[9] 기능을 강화하였다.

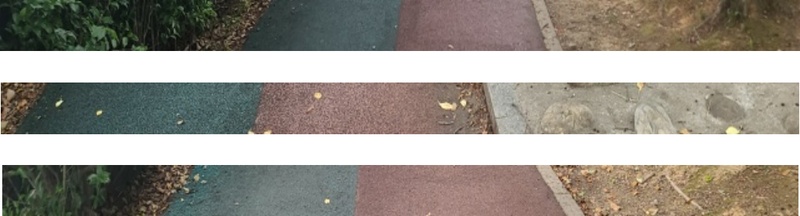

전방에 설치된 global shutter 카메라를 통해 실시간으로 보행로 영상을 획득하고, 인공지능 기반의 영상 분석 기법을 적용하여 보행로의 중심선을 인식하였다. 주행 경로 추정을 위한 중심선 인식은 Convolutional Neural Network(CNN) 기반의 딥러닝 모델을 활용하여 구현하였다[10]. 학습 데이터는 청소 대상 지역인 광주광역시 쌍암공원의 보행자 도로를 대상으로 수집하였다. 보행로를 따라 20 cm 간격으로 촬영된 총 20,107장의 영상을 확보하였으며, 이 중 16,000장을 학습용, 4,107장을 검증용 데이터로 활용하였다. 수집된 원본 영상은 데이터 전처리 과정에서 640 × 40 픽셀 크기로 슬라이싱하여 입력 데이터로 변환하였다. 이는 보행로 중심선 주변 정보에 집중하여 모델 학습 성능을 향상시키기 위한 전처리 과정이다.

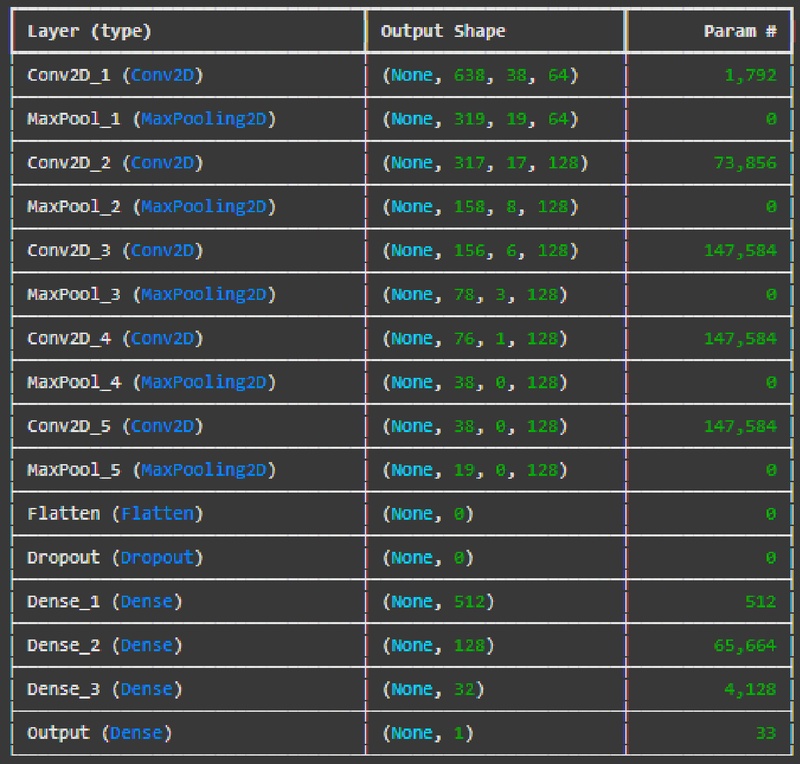

CNN 모델 구조는 Fig 10에서 나타난 바와 같이 모델은 입력 영상(640 × 40 × 3)을 받아, 다층의 convolution 및 MaxPooling 연산을 통해 특징(feature)을 추출하고, 완전연결층(dense layer)을 통해 최종 중심선 위치를 예측하는 구조를 가진다. 5개의 Convolution-Pooling 블록과 3개의 Dense layer로 구성되며, 과적합 방지를 위해 Dropout(0.5)을 추가하였다. 마지막 출력층은 중심선의 위치를 예측하기 위해 Softmax 함수를 활성화 함수로 사용하였다.

지도학습(supervised learning) 형태로 모델을 학습시켰으며, 입력 영상에 대해 중앙선의 위치를 픽셀 단위로 레이블링하여 중심선 좌표를 정답 데이터로 설정하였다. Fig. 11은 입력 영상의 예시와 중심선 레이블링 과정을 나타낸다.

실시간 추론 과정에서는 입력된 영상을 CNN 모델에 통과시켜 보행로 중심선 좌표를 예측하고, 예측된 중심선을 기준으로 desired heading angle을 계산한다. 이후 heading angle 제어 알고리즘을 적용하여 로봇의 진행 방향을 수정한다.

특히 여름철에는 나무가 무성하게 자라 GPS 신호가 차단되거나 산란되는 문제가 발생할 수 있는데, 이 경우에도 비전 기반 경로 인식 시스템과 IMU, wheel encoder 기반 odometry를 병행하여 안정적인 자율주행을 유지할 수 있도록 설계하였다.

최종적으로 학습된 CNN 모델은 Root Mean Square Error (RMSE) 기준 약 10cm 이내의 중심선 예측 정확도를 달성하였으며, Fig. 12에 나타난 바와 같이 실제 주행 실험 결과 경로 추종 오차를 ±12 cm 이내로 유지할 수 있었다.

4. 실외 환경 시범 운용 및 결과 분석

개발한 실외 청소 로봇의 자율주행 시스템을 실제 도시 공원 환경에서 검증하기 위해 시범 운용을 실시하였다. 주된 목표는 GPS 기반 Waypoint 주행과 Vision 기반 중심선 추출 기능이 실외 환경에서도 안정적으로 작동하는지를 평가하고, 주행 오차와 경로 이탈 여부를 분석하였다.

4.1 시험 장소 및 주행 조건

시범 운용은 광주광역시에 위치한 쌍암공원 내 보행로 구역을 대상으로 실시하였다. 시험 구간은 폭 약 2.5 m, 길이 약 300 m로 구성되어 있으며, 나무, 가로등, 벤치 등의 다양한 도시 가구물이 존재하는 환경이다.

주행 속도는 청소 작업 특성을 고려하여 2.5 km/h로 설정하였다. 경로 추종은 RTK-GPS를 활용한 waypoint 기반 주행을 기본으로 하였으며, GPS 수신이 불안정한 구간에서는 vision 기반 중심선 추출 알고리즘과 IMU, wheel encoder 기반 odometry를 병행하여 경로를 유지하였다.

시험 주행은 여름철을 포함하여 실시하여, 나무 잎이 무성한 상황에서도 GPS 신호 품질 저하 상황을 고려하였다. Fig. 13에 나타난 바와 같이 GPS 수신 상태는 GNSS 수신기 로그 데이터를 통해 기록하였고, 주행 중 로봇의 위치 데이터는 10 Hz 주기로 저장하여 주행 궤적 분석에 활용하였다.

4.2 실외 자율주행 시스템 성능 평가

시험 결과, 전체 주행 구간의 89%에서 RTK-GPS 기반 waypoint 추종이 정상적으로 수행되었다. GPS 신호가 약화된 11% 구간(주로 수목이 우거진 지역)에서는 vision 기반 중심선 추출 결과와 odometry를 통합하여 경로 추종을 이어갔다. 주행 궤적을 기준으로 측정한 경로 오차는 다음과 같다.

로봇의 heading angle 제어 결과, Table 2에서 나타난바와 같이 목표 heading 대비 평균 오차는 약 ±3.2o 이내로 유지되었으며, 이는 설정한 허용 오차 범위(±5o)를 만족하였다.

또한, waypoint 간 도달 판정은 평균 거리 오차 0.18 m 수준에서 이루어져 목표 경유점 전환 조건(0.2 m 이하)을 안정적으로 충족하였다.

시범 운용 결과, 본 연구에서 개발한 실외 청소 로봇의 자율주행 시스템은 다양한 실외 조건 하에서도 안정적인 경로 추종 성능을 보였다. 특히 vision 기반 경로 추정 시스템이 GPS 신호 불안정 상황에서도 주행을 지속할 수 있게 함으로써, 실외 환경 변화에 강인한 주행이 가능함을 확인하였다.

또한, heading angle 기반 주행 제어 방식을 적용하여 조향 기구의 기구적 오차 문제를 극복하고, 정밀한 경로 추종을 실현할 수 있었다. 시험 주행 동안 장애물 회피는 별도로 활성화하지 않고 진행하였으나, 경로 중심선을 안정적으로 유지함으로써 안전 주행이 가능하였다.

향후 연구에서는 장애물 인식 및 회피 기능을 추가하고, 다양한 환경(예: 비, 눈, 밤 시간대)에서도 안정적인 자율주행 성능을 확보하는 방향으로 시스템을 고도화할 계획이다.

5. 결 론

본 연구에서는 기존 유인형 청소 로봇을 기반으로 실외 자율주행이 가능한 무인 청소 로봇 시스템을 개발하고, 도시 공원 환경에서 그 성능을 검증하였다. 자율주행 기능을 구현하기 위해 하드웨어를 수정하고, RTK-GPS, LiDAR, 초음파 센서, 카메라 등을 통합한 센서 시스템을 설계하였다. 또한 조향 기구 오차 문제를 고려하여 Stanley 제어 방식을 수정한 heading angle 기반 경로 추종 알고리즘을 적용하였다.

Waypoints 기반 GPS 주행과 vision 기반 중심선 인식 기술을 병행하여, GPS 신호가 불안정한 구간에서도 안정적인 경로 추종을 유지할 수 있도록 시스템을 구성하였다. 실외 시범 운용 결과, 전체 주행 구간에서 평균 경로 추종 오차는 ±10 cm 이내로 유지되었으며, heading angle 제어 오차는 ±3.2o 수준으로, 실외 청소 작업을 위한 실용적 수준의 성능을 확인할 수 있었다.

특히 여름철과 같이 수목이 울창하여 GPS 신호 수신이 어려운 환경에서도, 비전 기반 경로 인식과 odometry를 융합하여 주행 안정성을 확보할 수 있음을 실험적으로 검증하였다. 이는 다양한 실외 환경 조건 하에서도 청소 로봇의 자율주행이 가능함을 보여주는 중요한 결과이다.

향후 연구에서는 장애물 인식 및 회피 기능을 추가하고, 다양한 기후 조건(비, 눈, 야간 등)에서도 안정적으로 자율주행이 가능한 시스템 고도화를 추진할 예정이다. 또한 청소 경로 최적화, 다중 로봇 협업 주행 기술 적용 등을 통해 청소 효율성과 작업 자동화를 더욱 향상시킬 계획이다.

References

-

Chang, M. S., Chou, J. H., Wu, C. M., 2010, Design and Implementation of a Novel Outdoor Road-Cleaning Robot, Adv. Robot., 24:1-2 85-101.

[https://doi.org/10.1163/016918609X12586141083777]

-

Megalingam, R. K., Vadivel, S. R. R., Kotaprolu, S.S., Nithul, B., Kumar, D.V., Rudravaram, G., 2025, Cleaning Robots: A Review of Sensor Technologies and Intelligent Control Strategies for Cleaning, J. Field Robot..

[https://doi.org/10.1002/rob.22515]

-

Ko, K.W., Lee, J.Y., 2022, Development of AI based Autonomous Driving System for Outdoor Cleaning Robot, Annual Conference of KIPS, 526-528.

[https://doi.org/10.3745/PKIPS.y2022m11a.526]

-

Mitchell, W., Staniforth, A., Scott, I., 2006, Cnalysis of Ackermann Steering Geometry, SAE Technical Paper 2006-01-3638.

[https://doi.org/10.4271/2006-01-3638]

-

Sahoo, S., Subramanian, S.C., Mahale, N., Srivastava, S., 2015, Design and Development of a Heading Angle Controller for an Unmanned Ground Vehicle, Int. J. Automot. Technol., 16 27-37.

[https://doi.org/10.1007/s12239-015-0003-8]

-

Yan, Y., Zhang, B., Zhou, J., Zhang, Y., Liu, X. A., 2022, Real-Time Localization and Mapping Utilizing Multi-Sensor Fusion and Visual–IMU–Wheel Odometry for Agricultural Robots in Unstructured, Dynamic and GPS-Denied Greenhouse Environments, Agronomy, 12:8 1740.

[https://doi.org/10.3390/agronomy12081740]

-

AbdElmoniem, A., Osama, A., Abdelaziz, M., Maged, S. A., 2020, A Path-tracking Algorithm using Predictive Stanley Lateral Controller, Int. J. Adv. Robot. Syst., 17:6.

[https://doi.org/10.1177/1729881420974852]

-

Bao, J., Yao, X., Tang, H., Song, A., 2018, Outdoor Navigation of a Mobile Robot by Following GPS Waypoints and Local Pedestrian Lane, IEEE 8th Annual International Conference on CYBER Technology in Automation Control and Intelligent Systems (CYBER), 198-203.

[https://doi.org/10.1109/CYBER.2018.8688182]

-

Lee, H. S., Yoo, K. H., Lee, S. W., Kim, J. M., Lee, C. S., 2023, Path Pursuit using Coverage DWA of Two Wheel Drive Robot, J. Korean Soc. Manuf. Technol. Eng., 32:4 242-250.

[https://doi.org/10.7735/ksmte.2023.32.4.242]

-

Farkh, R., Quasim, M. T., Al Jaloud, K., Alhuwaimel, S., Siddiqui, S. T., 2021, Computer Vision-Control-Based CNN-PID for Mobile Robot, Comput. Mater. Contin., 68:1 1065-1079.

[https://doi.org/10.32604/cmc.2021.016600]

Professor in the Department of Future Mobility, Halla University. His research interest is Machine Vision.

E-mail: kukwon.ko@halla.ac.kr