자동차 부품 제조 공정의 이미지 데이터 구축과 CNN‑기반 결함 분류기의 성능 평가

Abstract

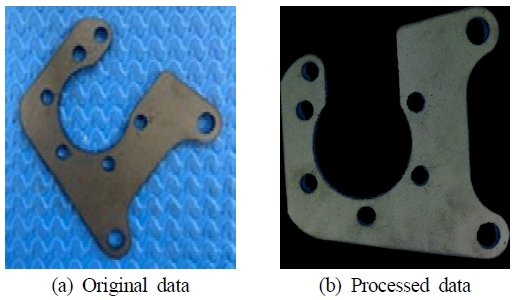

In this study, a deep-learning-based defect classification system was developed for the surface inspection of automotive parts. A compact conveyor-based setup was constructed to simulate the actual production conditions and ensure consistent image acquisition. To minimize background noise from the patterned belt, HSV (hue, saturation, value) color space segmentation and morphological filtering were applied. A lightweight VGG16-based convolutional neural network (CNN) was trained using transfer learning and partial fine-tuning. Despite using a small and balanced dataset, the model achieved over 95% validation and 95-100% prediction accuracy on unobserved test images. Therefore, CNNs can effectively classify known and previously undefined defects and thereby overcome the limitations of rule-based machine vision systems. Future studies will explore the integration of lighting control and the application of advanced models for real-time defect localization and classification.

Keywords:

CNN, Deep learning, Defect detection, VGG161. 서 론

엔진・섀시용 금속 부품은 μm 급 표면 결함(스크래치, 블리스터, 마이크로-크랙)이 피로 수명과 안전성에 직접적인 영향을 미친다. 국내 중견 부품사는 여전히 육안・현미경 검사와 룰-기반 머신비전에 의존하고 있는데, 이는 Takt-time을 따라가지 못하여 검사 속도 및 생산량 증가 시 라인 병목이 발생한다. 또한 검사의 편차 및 신뢰도가 작업자의 피로・숙련도에 의존한다.

따라서, 최근에는 룰 기반 머신비전과 CNN을 이용하여 결함을 분류하는 방법이 연구되고있다. 하지만 룰 기반 머신비전은 조명・포커스・배경 오염 등 외란에 취약해 스마트팩토리의 24 h 무인 품질 피드백 루프를 구현하기 어렵다[1]. 룰 기반 머신비전은 에지・임계값・템플릿 매칭 등 사람이 정의한 규칙을 이용한다. 표준 형태・조명 조건에서 빠르고 해석 가능하지만, 배경・광원 변동이나 예상하지 못한 결함 형상이 등장하면 규칙 세트를 재작성해야 하므로 실질적으로 “알 수 없는(unknown) 결함”은 검출하지 못한다. 최근 종합 리뷰에 따르면 룰 기반 머신비전 시스템은 조명 편차・표면 질감 변화가 큰 환경에서 검출률이 20% 이상 급격히 감소하며, 새로운 소재나 공정으로 확장할 때마다 추가 파라미터 조정이 불가피하다[2].

반면 딥러닝을 이용한 CNN은 대량의 정상・불량 사례를 통해 특징을 자동 학습하므로, 사람이 사전에 정의하지 않은 미지 결함 패턴도 분포의 “이상(anomaly)”으로 인식해 분류할 수 있다는 장점이 보고되고 있다. “Image-Based Surface Defect Detection Using Deep Learning”에서는 Layer 16~50층 CNN이 룰 기반 머신비전 대비 미지 결함 재현율을 35 % 향상시켰고, 표면 거칠기・스크래치・오염이 동시에 존재하는 복합 환경에서도 규칙 변경 없이 성능을 유지했다[3,4]. 또, 최신 비교 연구는 CNN이 다양한 배경・조명 아래서도 높은 정확도를 달성해, 룰 기반 머신비전을 완전히 대체할 수 있음을 입증하였다[5]. 따라서 CNN은 기존 룰 기반 머신비전으로는 놓칠 가능성이 높은 예측 불가・변형된 결함까지 포괄적으로 탐지할 수 있다는 점에서 스마트팩토리 품질 관리의 실질적 대안이 되고있다.

CNN과 같은 딥러닝을 이용한 모델인 YOLO[6-8]와 VGG16은 특징을 스스로 학습하므로 조건 모델링 부담을 줄이고, 결함 형태가 복잡한 공정에도 적용 폭이 넓다[9-11]. YOLO 계열 모델은 한 번의 추론으로 다수 객체의 위치와 종류를 동시에 예측할 수 있어 실시간성이 우수하고, 최신 버전인 YOLOv5s는 전 세대 YOLOv3보다 추론 속도와 mAP가 모두 향상되었다는 연구가 보고되어 있다[12]. 그러나 정확한 바운딩 박스 주석이 필수라 데이터 구축 비용이 높고, 공간 좌표・크기까지 회귀해야 하므로 파라미터 수가 많아 경량화・튜닝 부담이 크다는 한계가 존재한다[12].

반면, VGG16과 같은 CNN 기반 분류 모델은 복잡한 하이퍼파라미터 없이 이미지 특징을 자동으로 학습하므로 라벨링 부담이 낮으며, 객체 위치 정보가 필요 없는 합・불 판정 문제에 적합하다. 실제로 수백 장 규모의 데이터에도 95% 이상의 분류 정확도를 기록한 사례가 다수 보고되었고[13,14], 밝기・노이즈・촬영 각도를 변화시키는 증강 기법을 적용하면 단일 모노카메라 환경에서도 성능이 추가로 향상된다는 결과도 확인되었다[12,13,15].

따라서 본 연구에서는 바운딩 박스가 아닌 합・불 여부 판정이 핵심인 부품 프레스 라인에 초점을 맞추어, 데이터 증강과 전이학습을 통해 파라미터를 경량화한 VGG16 모델을 채택하였다. 이를 통해 적은 데이터와 짧은 학습 시간으로도 현장 투입 가능성을 검증하고자 한다.

2. 소형화 컨베이어 시스템 및 이미지 획득 ・ 전처리

2.1 실제 공정 모사용 소형 컨베이어 시스템 구축

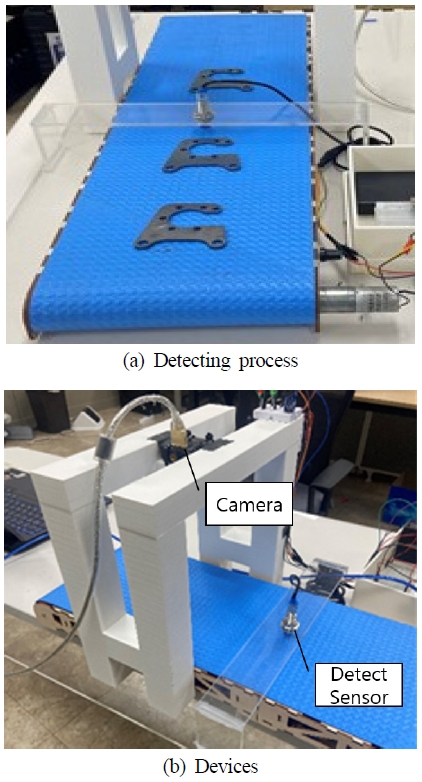

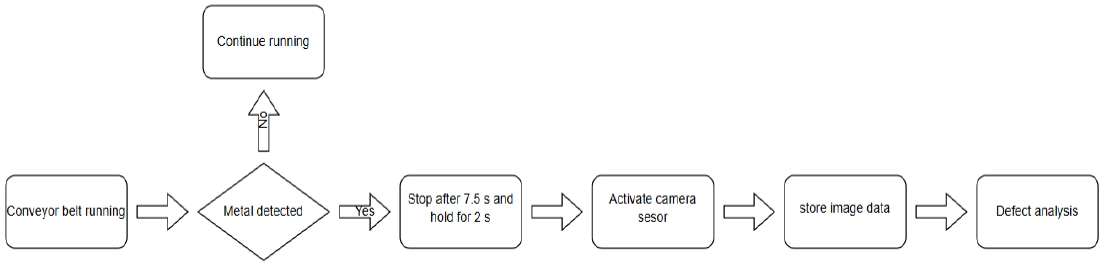

본 연구는 실제 양산 라인을 축소한 실험 시스템을 설계하였다. 카메라는 oCam-5CRO-U-M을 사용하였으며 카메라와 부품간의 수직 간격은 218 mm(부품 두께: 2 mm)로 배치하였다.

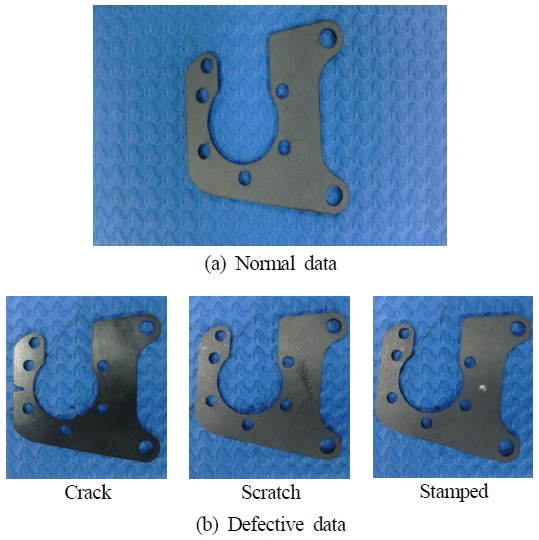

또한 시스템의 처리 과정을 Fig. 1 및 Fig. 2에 나타내었다. 이러한 공정 과정을 구축하여 실사용 가능한 데이터를 Fig. 3과 같이 추출하여 사용하였고, 설치 장소에 따른 환경 변화가 모델 성능에 미치는 영향을 반영하기 위해, 학습용 데이터는 동일한 장비를 서로 다른 장소 4곳에 배치하여 수집하였다. 불량의 종류로는 크랙, 스크래치, 찍힘으로 설정하였다.

3. CNN

3.1 단순 CNN 모델의 비교

기존의 단순 CNN과의 비교를 위해 선행 연구에서 수행된 3개의 합성곱 층과 2개의 완전 연결층으로 구성하여 동일한 시스템・조명 조건에 맞추어 학습된 모델이 학습 분포 내 데이터에 대해서는 양호한 성능을 보이지만 학습에 포함되지 않은 외삽 데이터에 대해서는 Fig. 5와 같이 예측 성능이 급격히 저하 되어 불량 부품을 정상으로 판별하는 한계가 반복적으로 확인되었다. 따라서, 본 연구에서는 정확도를 높이기 위해 진보된 CNN 모델로 알려진 VGG16Net을 적용하였다.

3.2 VGG16Net

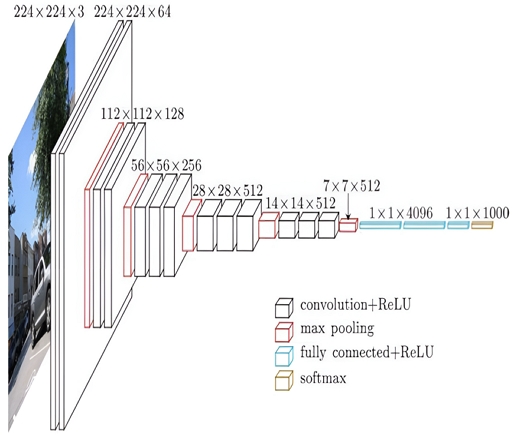

VGG16는 Simonyan & Zisserman이 ILSVRC-2014에서 발표한 Fig. 6인 “Very Deep Convolutional Networks for Large-Scale Image Recognition” 논문에서 처음 제안되었다. 이 모델은 3 × 3 Convolution을 연속으로 쌓아 깊이를 16 개 가중치 층까지 확장하면서도 파라미터 수를 억제하고, 각 블록 뒤 2 × 2 Max-Pooling으로 연산량을 관리해 당시 ImageNet top-5 오류율 7.5%를 기록하였다[16]. VGG16의 규칙적인 “Conv-3 × 3 – ReLU – MaxPool” 반복 구조는 하이퍼파라미터 탐색과 하드웨어 최적화를 단순화하며, 깊이를 조정해도 일관성을 유지한다. 공개된 ImageNet 사전학습 가중치는 소규모 표면 결함 데이터에도 빠르게 수렴한다는 점이 여러 제조 연구에서 입증되었는데, 예를 들어 강판 스트립 결함 검출 연구에서 VGG16기반 전이학습 모델이 95 % 이상의 분류 정확도를 보고하였고[17], 알루미늄 압출재 표면 결함 연구에서도 유사한 수준의 성능이 확인되었다. 원본 VGG16은 Flatten-4096-4096-1000(fully-connected layer)을 포함해 약 1억 3천만 개 파라미터를 가지므로, 소량 데이터・경량 장치 환경에서는 과적합과 자원 부담이 크다.

본 연구에서는 Table 1과 같이 include_top=False (Keras의 사전학습 모델 VGG16, ResNet 등을 불러올 때 맨 위 분류 층은 빼고 가져옴) 옵션으로 Convolution 백본 (약 1천 470만 파라미터)만 가져오고, 그 뒤에 Global Average Pooling → Dense 128(ReLU) → Dropout 0.5 → Dense 2(Softmax)로 얕은 헤드를 추가해 전체 파라미터를 약 6만 6천 개로 줄였다. 이 경량화는 소량 데이터에서도 과적합을 크게 완화한다. 학습은 2단계로 진행하였다. 첫 단계에서는 백본을 동결한 채 새 Dense-head만 학습해 기본 분류 경향을 확보하고, 두 번째 단계에서 상위 4개의 Convolution Layer만 풀어 부분 파인튜닝을 수행한다. 이러한 전략은 사전학습된 일반 시각 특징을 유지하면서 도메인 특화 정보를 학습해 성능을 높이는 방법으로 여러 제조 분야 결함 검출 연구에서 효과가 확인되었다[18].

3.3 모델 학습 결과 요약

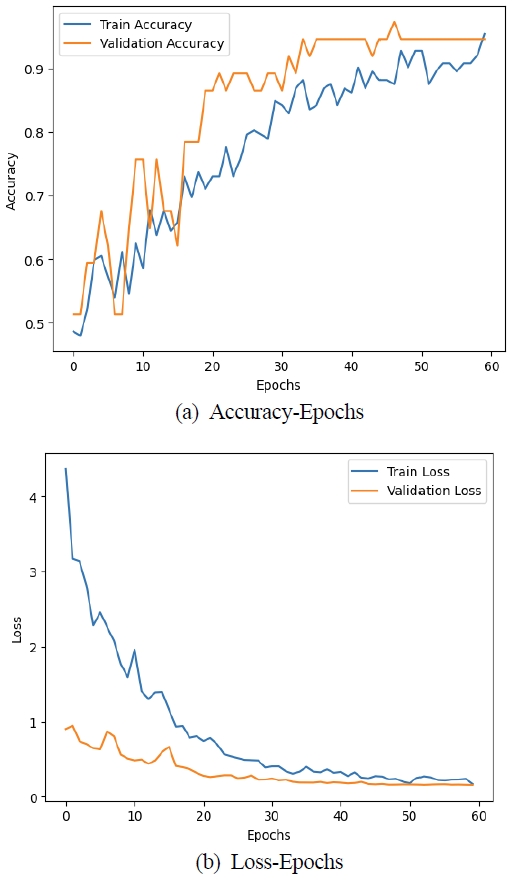

Fig. 7은 2단계의 60 epochs(40 epochs + 20 epochs) 동안의 정확도 및 손실 곡선이다. 초기 0 – 15 epoch 구간에서는 소규모 데이터로 인한 진동이 관찰되지만, 배경 제거・증강 효과로 학습이 안정화되면서 Train Accuracy ≈ 0.95, Validation Accuracy ≈ 0.95 수준까지 수렴한다. Dropout 0.5와 클래스 가중치 덕분에 검증 곡선이 훈련 곡선을 꾸준히 상회해 과적합 징후가 나타나지 않았다. Fig. 7(b)의 손실 곡선은 epoch가 진행될수록 지수 함수형으로 감소하며, 마지막 구간에서 훈련・검증 손실이 각각 0.13 / 0.06 부근으로 수렴한다. 이는 전이된 일반 시각 특징이 우리 도메인(자동차 부품)으로 원활히 적응했음을 시사한다. 배경 제거-전처리와 부분 파인튜닝 조합이 소량 데이터에도 불구하고 검증 정확도 95% / 손실 0.06까지 끌어올렸으며, 파라미터 경량화 덕분에 스마트팩토리 현장의 저전력 GPU로도 손쉽게 배포할 수 있음을 확인하였다.

3.4 모델 성능 평가

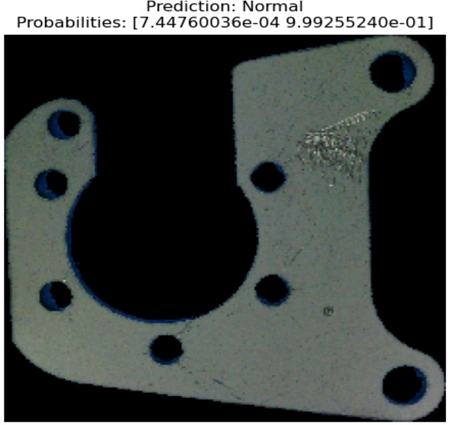

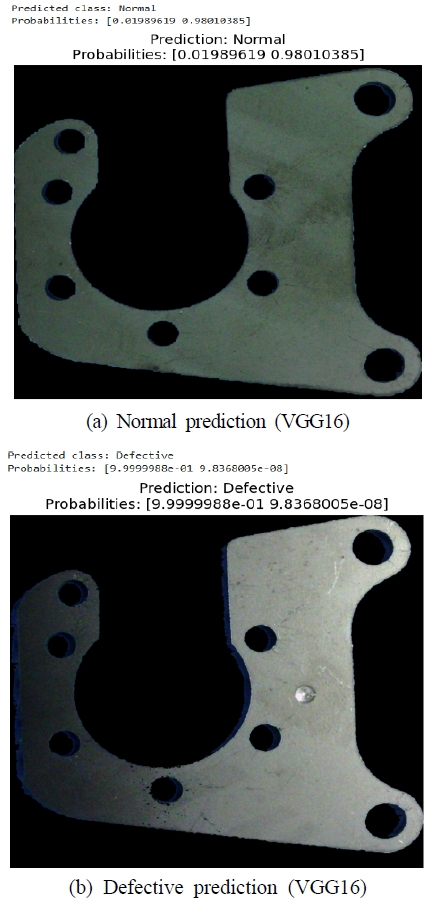

본 모델의 일반화 능력을 확인하기 위해 훈련・검증 세트에 포함되지 않은 외부 이미지에 대해 추가 예측 실험을 수행하였다. 외부 세트는 동일 컨베이어 시스템에서 별도로 촬영한 정상・불량 샘플 40장을 수집해 구성하였으며, 학습 파이프라인과 동일한 HSV-마스킹・캔버스 정렬 전처리를 거친 뒤 추론만 실행하였다. 그 결과, 모델은 정상 샘플 20장과 불량 샘플 20장 모두 정확히 분류해 총 정확도 100%(정확도 범위 95~100%)를 기록하였다. 내부 검증(accuracy 95%)을 상회하는성능을 보이는 것을 확인하였다. Fig. 8은 모델이 훈련 데이터에 과도하게 의존하지 않고, 동일 라인에서 새로 촬영된 이미지에도 높은 신뢰도로 일반화됨을 보여준다. 결과에서 알 수 있듯이, 실험 환경 및 촬영 조건을 자동화 설비 내에서 엄격히 제어하면(컨베이어 속도, 부품 위치, 카메라 - 부품 간 거리 등 고정) 상대적으로 작은 데이터 수에서도 컨베이어 시스템이 배치되는 장소가 변경되어도 안정적인 분류 성능을 확보할 수 있는 것을 확인하였다. 또한, 부품의 테두리 부분에서의 배경 처리가 정밀하지 못하지만 그 특징마저 학습하여 정확하게 분류하는것을 알 수 있다. 하지만 추후의 실험에서의 결과로 어두운 환경에서 실시하면 데이터에 명암이 생겨 모델의 정확도가 현저히 떨어지는 현상을 발견했으며, 실제 작업 환경(광원, 오염도, 측정 각도 변화)에 영향이 적은 강건한 모델 개발은 추가 연구가 필요하다.

4. 결 론

본 연구는 자동차 부품의 표면 결함을 효과적으로 분류하기 위해 실제 생산 공정을 소형화한 컨베이어 시스템을 직접 설계하고, 안정적인 데이터 확보 환경을 구축한 뒤 VGG16기반 전이학습 모델의 딥러닝 분류기를 학습・검증하였다. 컨베이어 시스템은 실제 라인과 유사한 청색 무늬 벨트를 사용하고, 외광・배경 변수의 영향을 최소화하여 촬영 조건의 기본 일관성을 확보하였다. 획득된 원본 이미지에 대해서는 HSV 변환 및 배경 제거 알고리즘을 구현하여, 부품 이외의 배경 정보를 최소화하고 모델의 과적합을 방지하였다. 그 결과, 학습에 활용된 이미지 데이터의 품질을 일정하게 유지할 수 있었으며, 데이터 전처리 과정을 수행하였다. 모델 구성은 VGG16의 사전학습 백본을 활용하고, include_top= False로 분류기를 제거한 후 Global Average Pooling과 Dense Layer로 구성된 얕은 분류기 헤드를 추가하여 경량화하였다. 전체 모델 중 학습 대상 파라미터는 약 0.45% 수준으로 제한하였으며, 두 단계 학습 전략(1단계 dense-head 학습, 2단계 일부 conv layer fine-tuning)을 적용해 검증 정확도 95%의 성능을 달성하였다. 또한, 외부의 미사용 이미지 40장에 대한 테스트 결과에서도 정확도 95~100%의 일반화 성능을 확인하였다. 이러한 결과는 소량의 결함 이미지로도 적절한 설계와 전처리를 통해 높은 정확도의 분류 모델을 구축할 수 있음을 보여주며, 기존 룰 기반 머신비전이 분류하기 어려운 예측 불가 결함에 대해서도 CNN 기반 모델이 유의미한 판별력을 가진다는 점을 실험적으로 입증하였다. 본 연구는 소규모 제조 환경에서도 실현 가능한 AI 기반 품질 검사 체계를 제시하며, 향후에는 결함의 세부 유형 분류 및 결함 위치 시각화까지 확장하는 통합 비전 시스템 개발로 이어질 수 있을 것이다. 본 연구의 목표 정확도인 95%를 만족했기 때문에 타 모델과의 비교는 하지 않았지만 최근 활발히 개발되고 있는 Efficient Net, ConvNeXt, Vision Transformer(ViT) 계열의 다양한 고성능 모델들도 본 연구 환경에 적용할 경우, 정확도・처리 속도・모델 경량성 측면에서 더욱 우수한 결과를 도출할 수 있을 것으로 기대되며, 이에 대한 후속 비교 실험 및 최적 모델 탐색 연구도 함께 진행할 예정이다. 아울러 추후에는 컨베이어 시스템에 전용 조명을 설치하여 조도 편차를 보다 정밀하게 통제하고, 오염도・카메라 각도를 실험 설계 요인으로 설정한 다인자 실험을 통해, 제안 모델의 환경 강건성을 정량적으로 평가하고, 장시간 운용 시 모델의 성능 일관성을 더욱 높이는 방향으로 실험 환경을 개선할 계획이다.

Acknowledgments

이 연구는 경상북도RISE체계-K-LEARNing 프로젝트:로컬 이슈 해결의 지원을 받아 수행되었음.

References

-

Büchi, G., Cugno, M., Castagnoli, R., 2020, Smart Factory Performance and Industry 4.0, Technol. Forecast. Soc. Change, 150 119790.

[https://doi.org/10.1016/j.techfore.2019.119790]

-

Chen, Y., Ding, Y., Zhao, F., Zhang, E., Wu, Z., Shao, L., 2021, Surface Defect Detection Methods for Industrial Products: A Review, Appl. Sci., 11:16 7657.

[https://doi.org/10.3390/app11167657]

-

Bhatt, P. M., Malhan, R. K., Rajendran, P., Shah, B. C., Thakar, S., Yoon, Y. J., Gupta, S. K., 2021, Image-Based Surface Defect Detection Using Deep Learning: A Review, J. Comput. Inf. Sci. Eng., 21:4 040801.

[https://doi.org/10.1115/1.4049535]

-

Lee, M., Seo, K., 2018, Comparison of Region-based CNN Methods for Defects Detection on Metal Surface, The Transactions of The Korean Institute of Electrical Engineers, 67:7 865-870.

[https://doi.org/10.5370/KIEE.2018.67.7.865]

-

Ameri, R., Hsu, C.-C., Band, S. S., 2024, A Systematic Review of Deep Learning Approaches for Surface Defect Detection in Industrial Applications, Eng. Appl. Artif. Intell., 130 107717.

[https://doi.org/10.1016/j.engappai.2023.107717]

-

Redmon, J., Divvala, S., Girshick, R., Farhadi, A., 2016, You Only Look Once: Unified, Real-Time Object Detection, Proc. IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 779-788.

[https://doi.org/10.1109/CVPR.2016.91]

-

Lee, S.-w., Yoo, K.-h., Kang, Y.-g., Kim, J.-m., Lee, C.-s., 2023, Strawberry-harvesting Robot System with Object Detection Based on YOLO, J. Korean Soc. Manuf. Technol. Eng., 32:2 101-108.

[https://doi.org/10.7735/ksmte.2023.32.2.101]

-

Kim, J. G., Kang, J.-H., Choi, K.-C., Jang, W.-K., Ha, H.-J., Lim, K.-S., Kim, B.-H., Park, Y.-J., 2022, Development of a Normal/Abnormal RBC Detection Algorithm using YOLOv5, J. Korean Soc. Manuf. Technol. Eng., 31:2 94-100.

[https://doi.org/10.7735/ksmte.2022.31.2.94]

- Kim, Y. S., 2024, Review Paper for Key Algorithms of Machine Learning and its Application to Material Processing Problems, Transactions of Materials Processing, 33:1 55-72. <https://koreascience.kr/article/JAKO202408543215454.page, >.

- Kim, Y. S., 2024, Key Algorithms of Machine Learning and its Application to Material Processing Problems II, Transactions of Materials Processing, 33:2 132-150. <https://www.koreascience.kr/article/JAKO202411343412463.page, >.

- Kim, Y. S., 2024, Machining Learning and Its Application to Material Processing Problem III - RNN, LSTM, CNN, Transactions of Materials Processing, 33:3 214-230. <https://koreascience.kr/article/JAKO202417258803935.view?orgId=anpor, >.

-

Kim, I.-S., Lee, M. G., Jeon, Y., 2021, Comparative Analysis of Defect Detection Using YOLO of Deep Learning, J. Korean Soc. Manuf. Technol. Eng., 30:6 514-519.

[https://doi.org/10.7735/ksmte.2021.30.6.513]

-

Wang, J., Lee, S., 2022, Data Augmentation Method for Training Convolutional Neural Networks to Inspect Amorphous Defects in Machine Vision Systems Using Mono Cameras, Trans. Korean Soc. Mech. Eng.- A, 46:1 49-56.

[https://doi.org/10.3795/KSME-A.2022.46.1.049]

-

Kumaresan, S., Aultrin, K. S. J., Kumar, S. S., Anand, M. D., 2023, Deep Learning-Based Weld Defect Classification Using VGG16 Transfer Learning Adaptive Fine-Tuning, Int. J. Interact. Des. Manuf., 17:6 2999-3010.

[https://doi.org/10.1007/s12008-023-01327-3]

-

Kim, S. B., Lee, K. A., 2022, Study on the Surface Defect Classification of Al 6061 Extruded Material By Using CNN-Based Algorithms, Transactions of Materials Processing, 31:4 229-239.

[https://doi.org/10.5228/KSTP.2022.31.4.229]

-

Simonyan, K., Zisserman, A., 2015, Very Deep Convolutional Networks for Large-Scale Image Recognition, International Conference on Learning Representations, 1-14.

[https://doi.org/10.48550/arXiv.1409.1556]

-

Ibrahim, A. A. M. S., Tapamo, J. R., 2024, Transfer Learning-Based Approach Using New Convolutional Neural Network Classifier for Steel Surface Defects Classification, Scientific African, 23 e02066.

[https://doi.org/10.1016/j.sciaf.2024.e02066]

-

Li, Z., Li, B., Ni, H., Ren, F., Lv, S., Kang, X., 2022, An Effective Surface Defect Classification Method Based on RepVGG with CBAM Attention Mechanism (RepVGG-CBAM) for Aluminum Profiles, Metals, 12:111809.

[https://doi.org/10.3390/met12111809]

Undergraduate Course in the Department of Automotive Engineering, Yeungnam University. His research interests include Machine Learning and Metal Forming.

E-mail: ej3768@yu.ac.kr

Undergraduate Course in the Department of Automotive Engineering, Yeungnam University. His research interest interests include Material Behavior and Characterization.

E-mail: dwc4716@naver.com

Undergraduate Course in the Department of Automotive Engineering, Yeungnam University. His research interests include Machine Learning, Artificial Intelligence, Structural Analysis, Manufacturing Process Design, and Materials Testing.

E-mail: kbm4765@naver.com

Undergraduate Course in the Department of Automotive Engineering, Yeungnam University. His research interests include Machine Learning-Based Prediction of Stress–Strain Behavior under Different Strain Rates.

E-mail: young0joon@naver.com

Professor in the Department of Automotive Engineering, Yeungnam University.

His research interests include Material Modeling, Machine Learning in Manufacturing System.

E-mail: Jinjae.Kim@yu.ac.kr